写真

AI写真项目拆解,手把手教学新手教程,ComfyUI版

Overseas 发表了文章 • 2024-03-22 10:23

一、分步制作

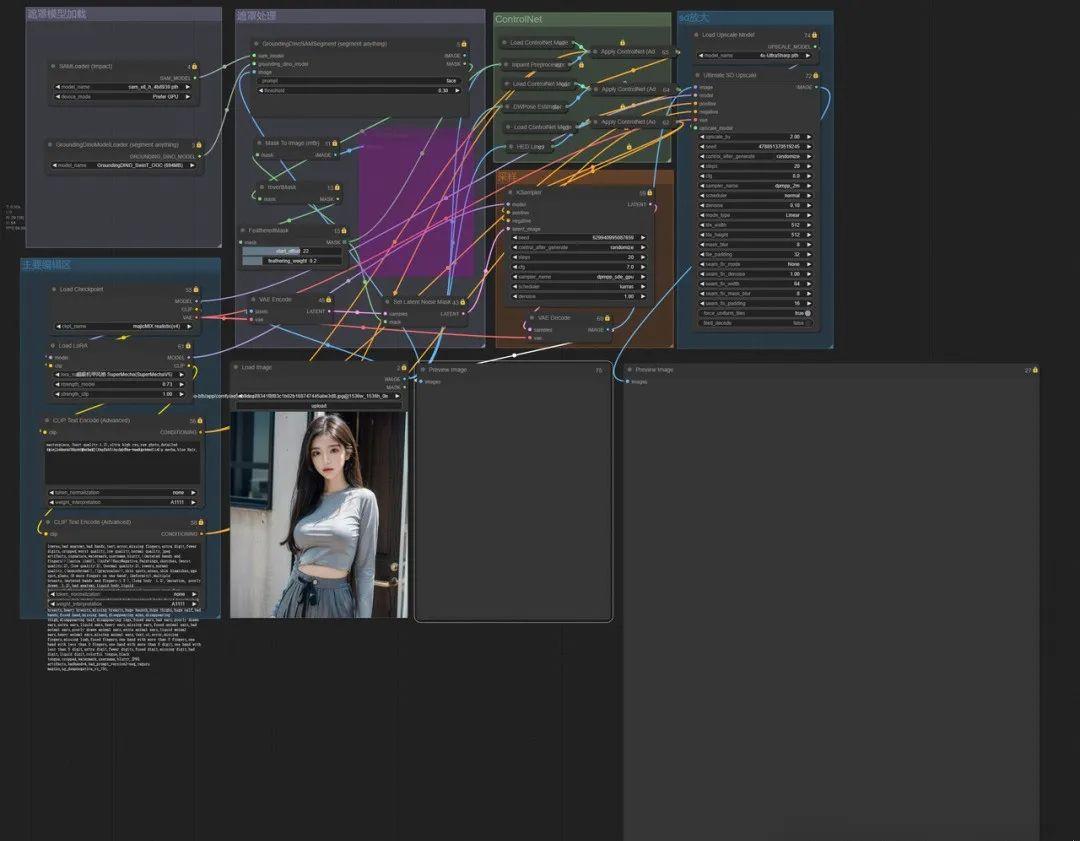

根据写真的SOP教程,蒙版变装的方法分为了四部分:

1、制作蒙版2、SD基础设置3、ControlNet设置4、修图

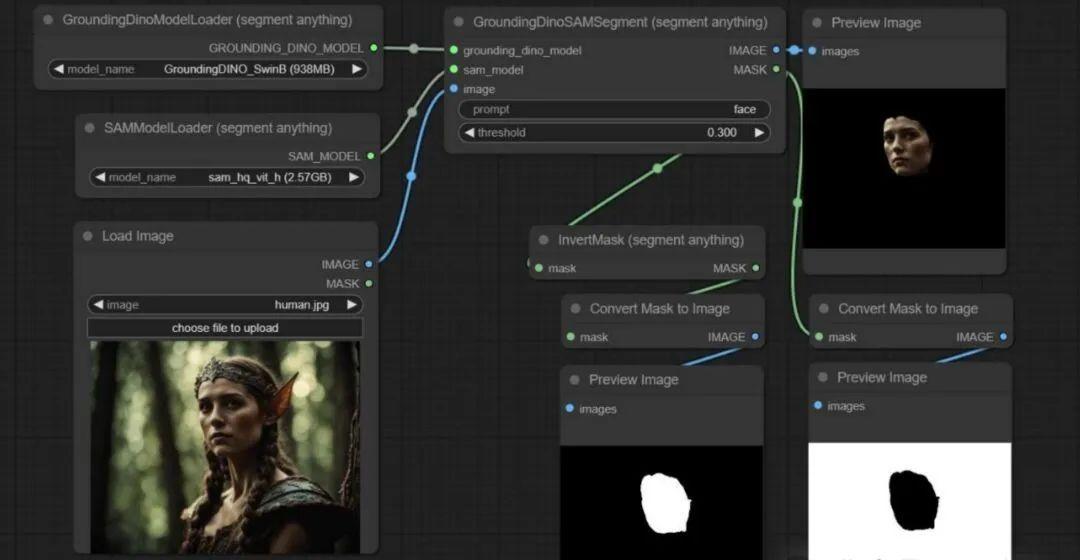

1、制作蒙版

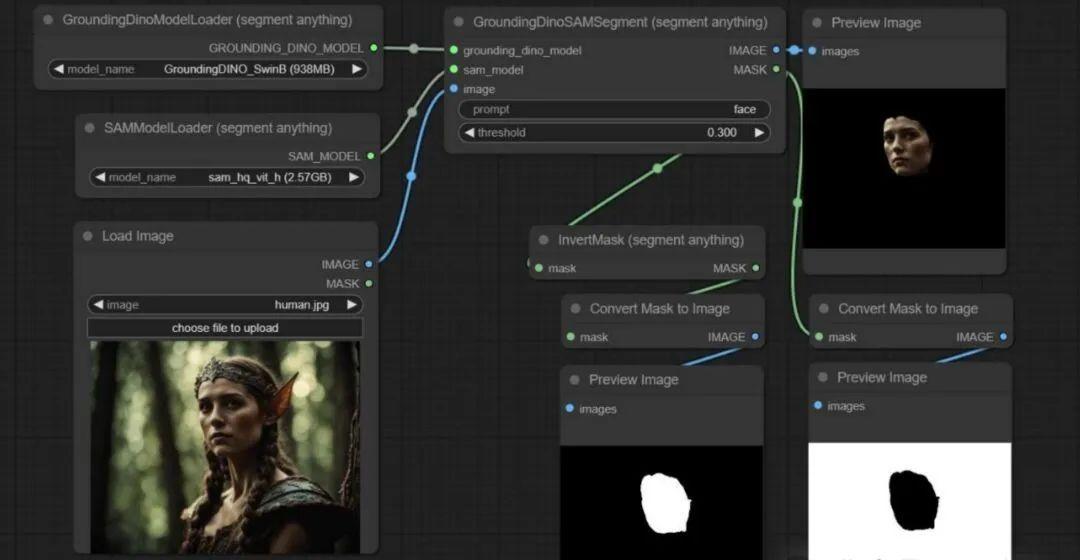

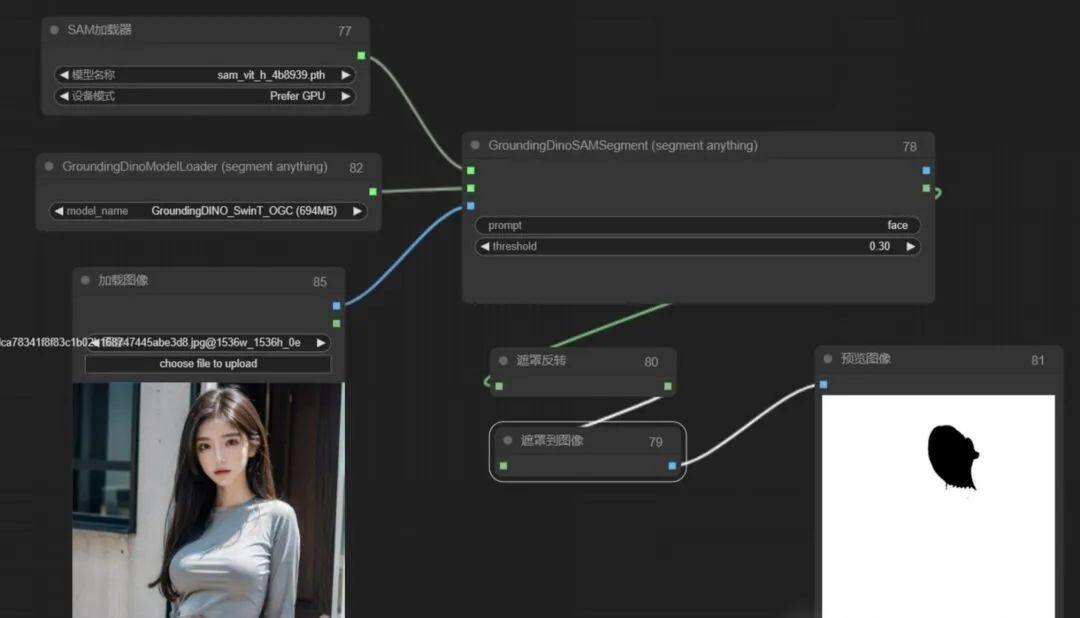

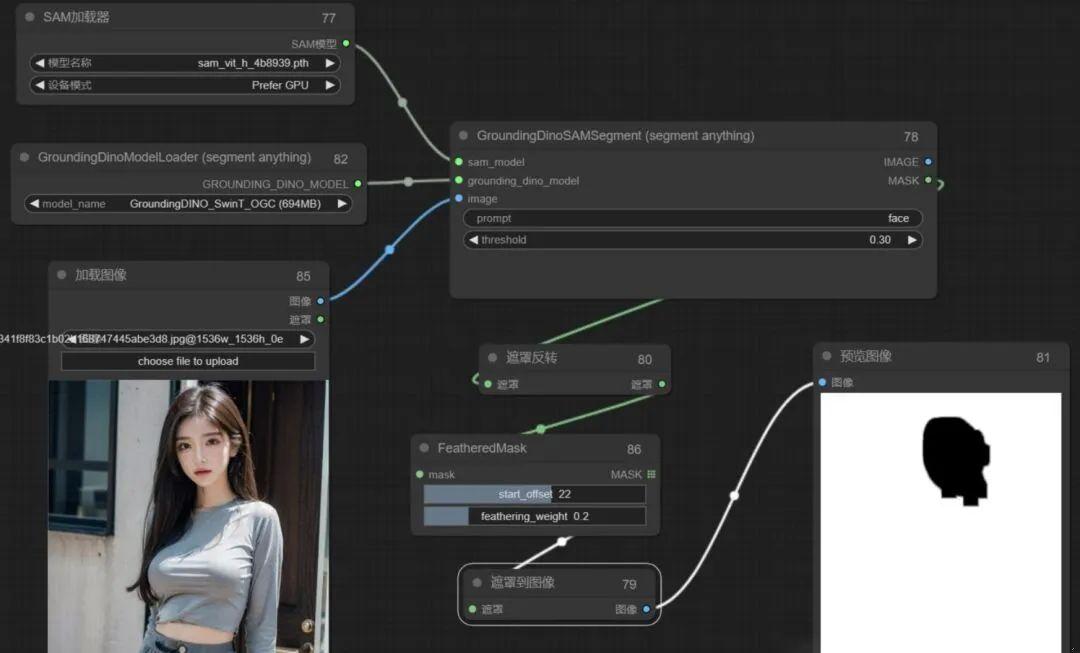

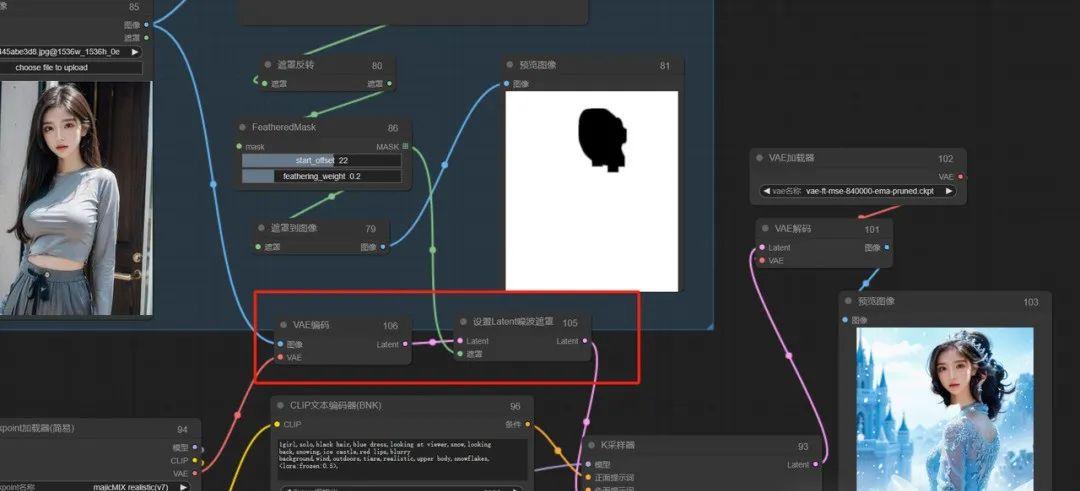

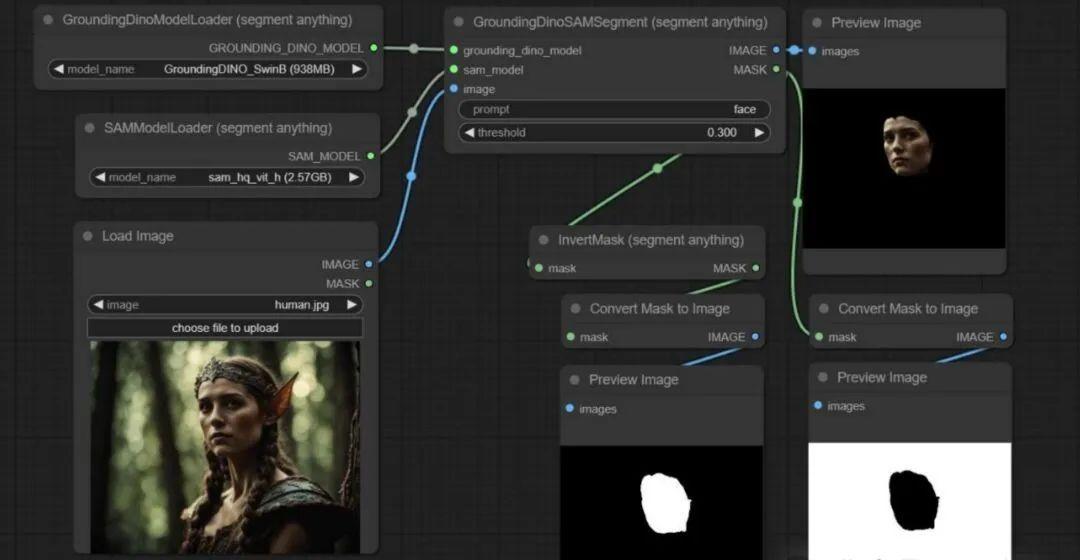

根据教程中显示,制作蒙版是把脸部蒙版精准抠出,我们需要通过分割算法把脸部自动抠出,这里用到可以分割一切的seg(segment anything)

比葫芦画瓢,于是,小姐姐的脸完美扣出来了:

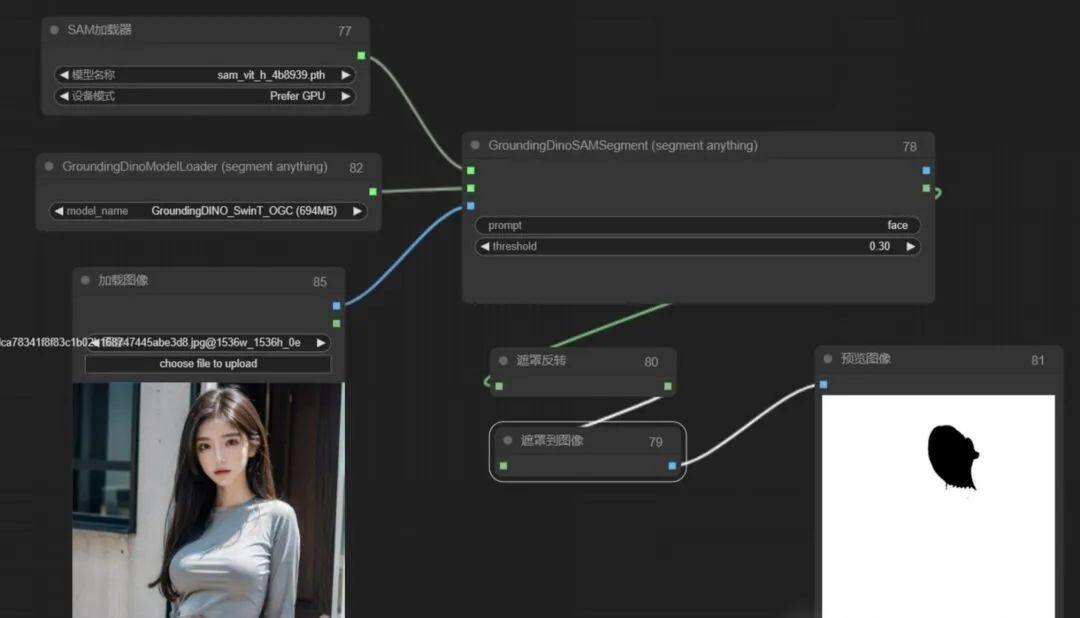

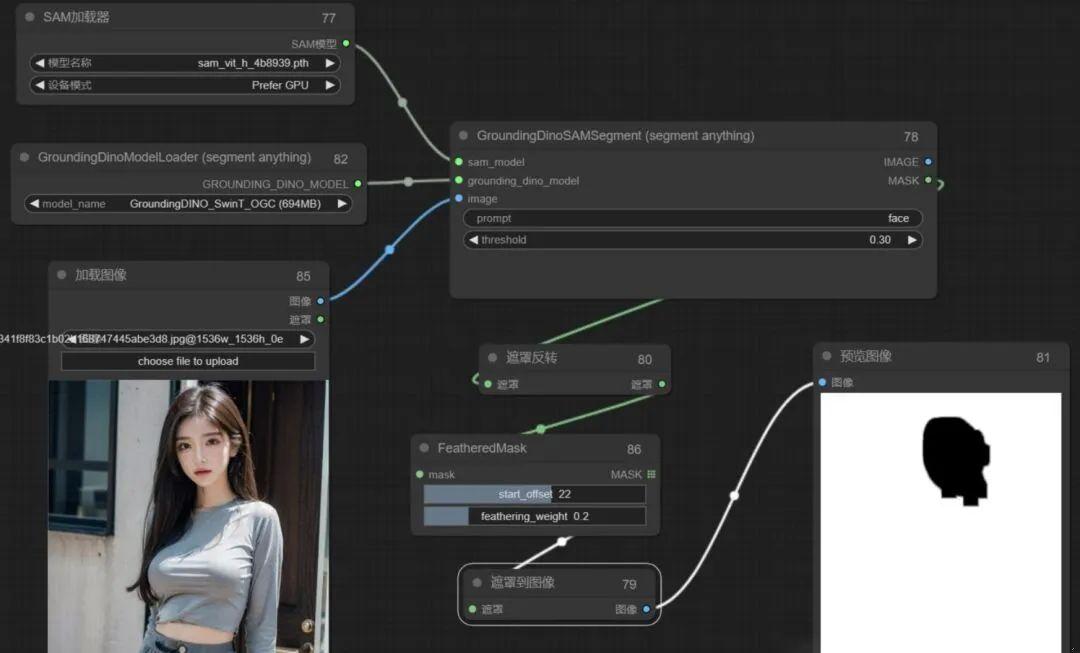

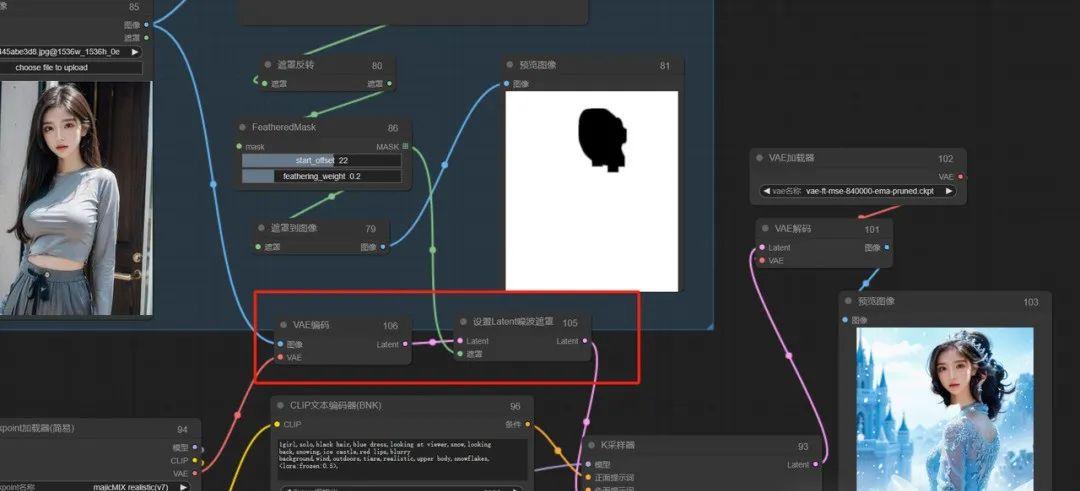

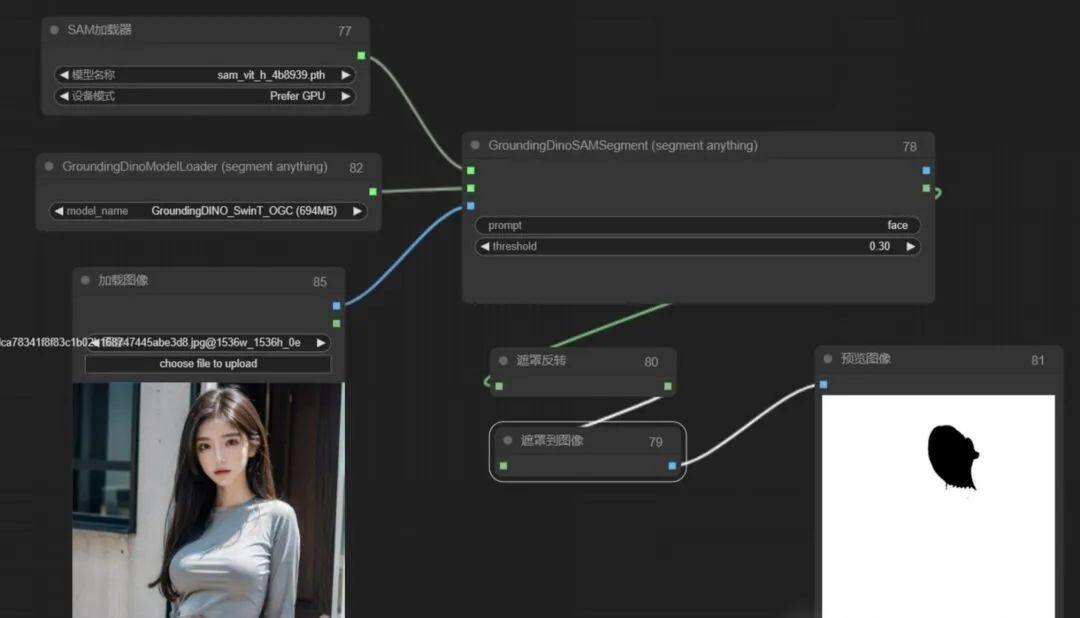

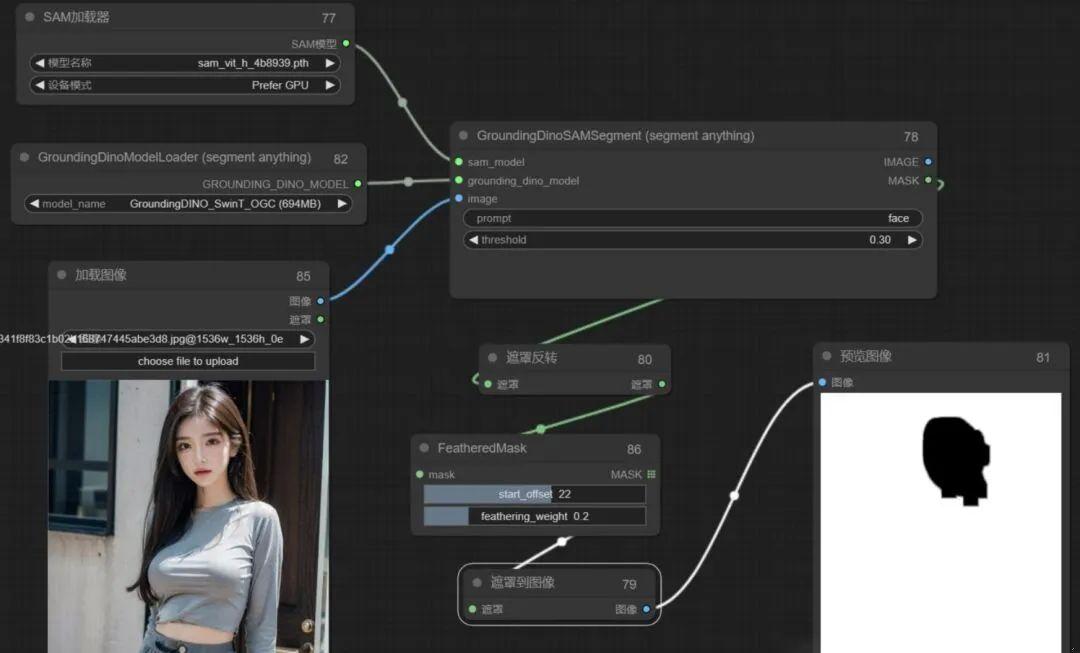

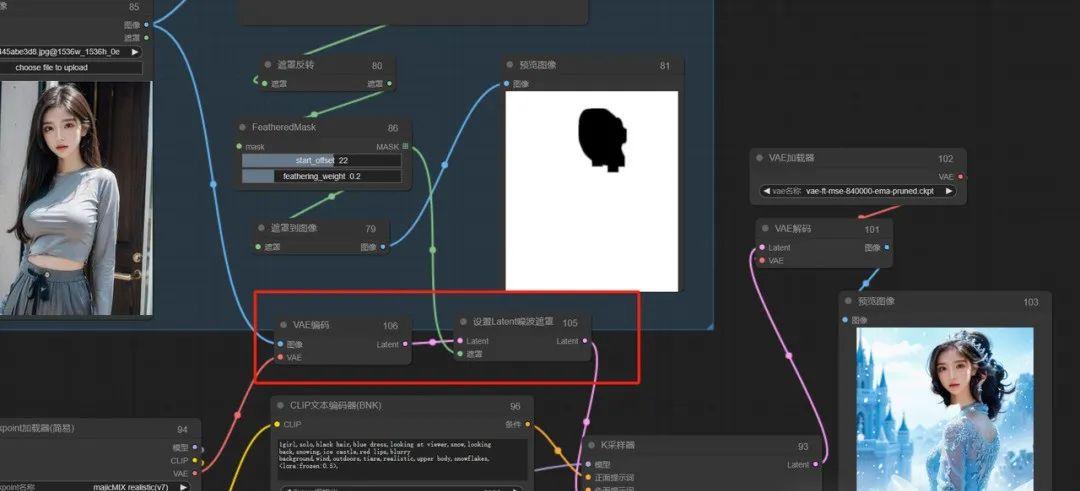

但在后期所有步骤连成后,发现遮罩边缘部分衔接不是太好,查了部分资料,发现是遮罩边缘太锋利导致,于是此处流程仍需要对蒙版边缘做羽化处理,核心节点就有,但试了一下,边缘依然比较清晰,发现核心节点feather mask是对整个图进行羽化,这不是我们想要的,我们只想对脸部进行羽化,这里用的是FeatheredMask节点。

通过FeatheredMask节点完美实现对边缘的羽化处理,如下图可以看到边缘明显不那么锐利:

到这里,第一步制作蒙版基本就达到我们想要的效果了。

2、SD基础设置

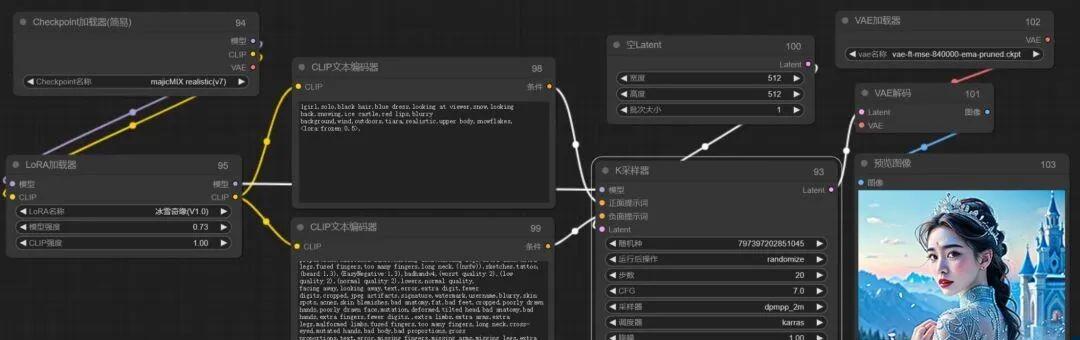

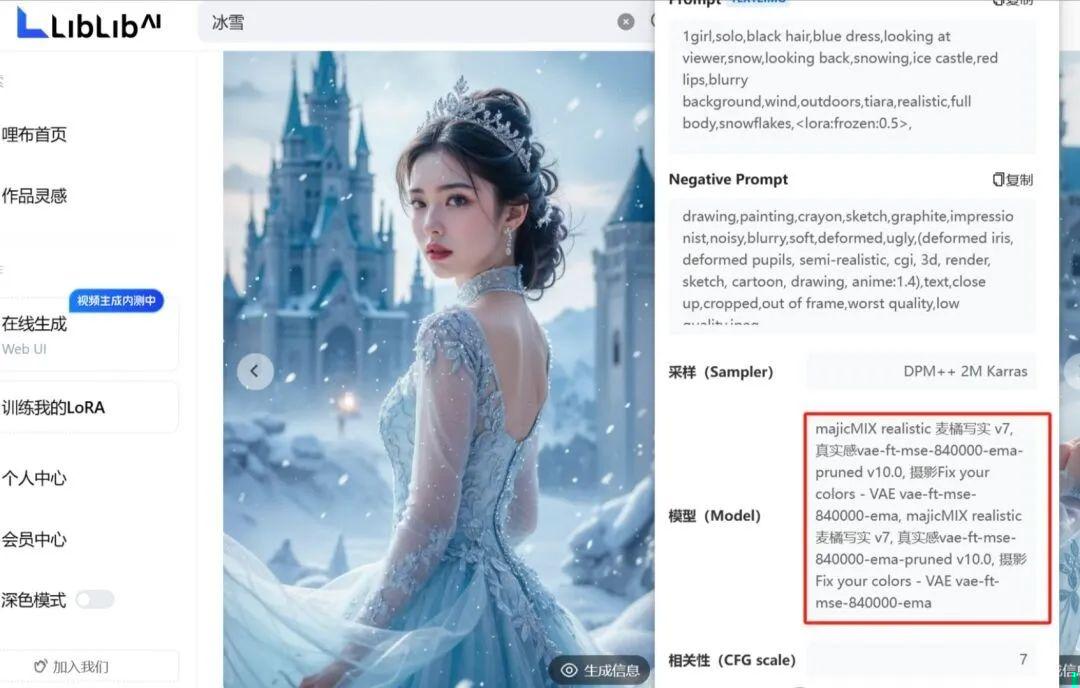

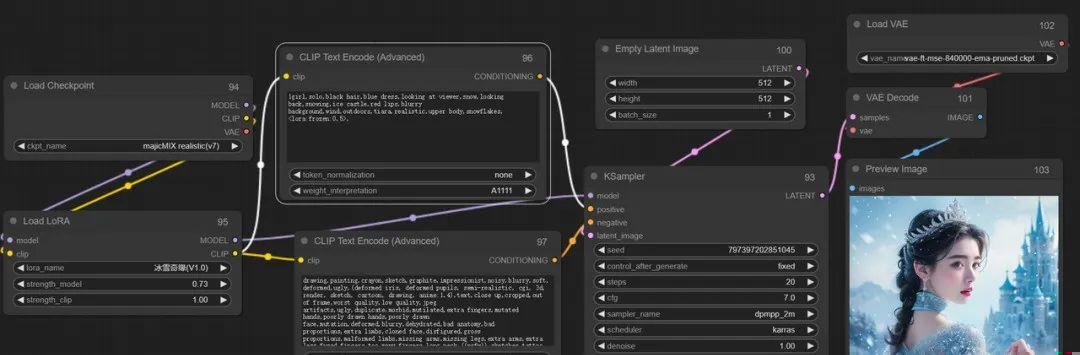

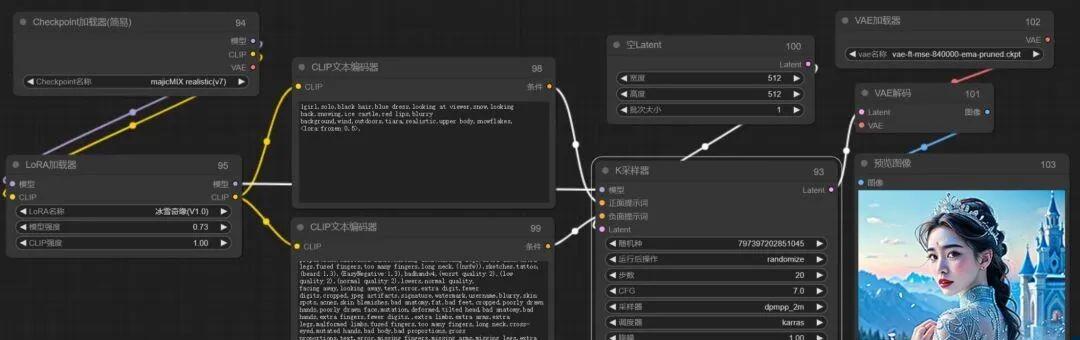

玩过ComfyUI的同学,相信这一步应该非常熟练的还原教程。

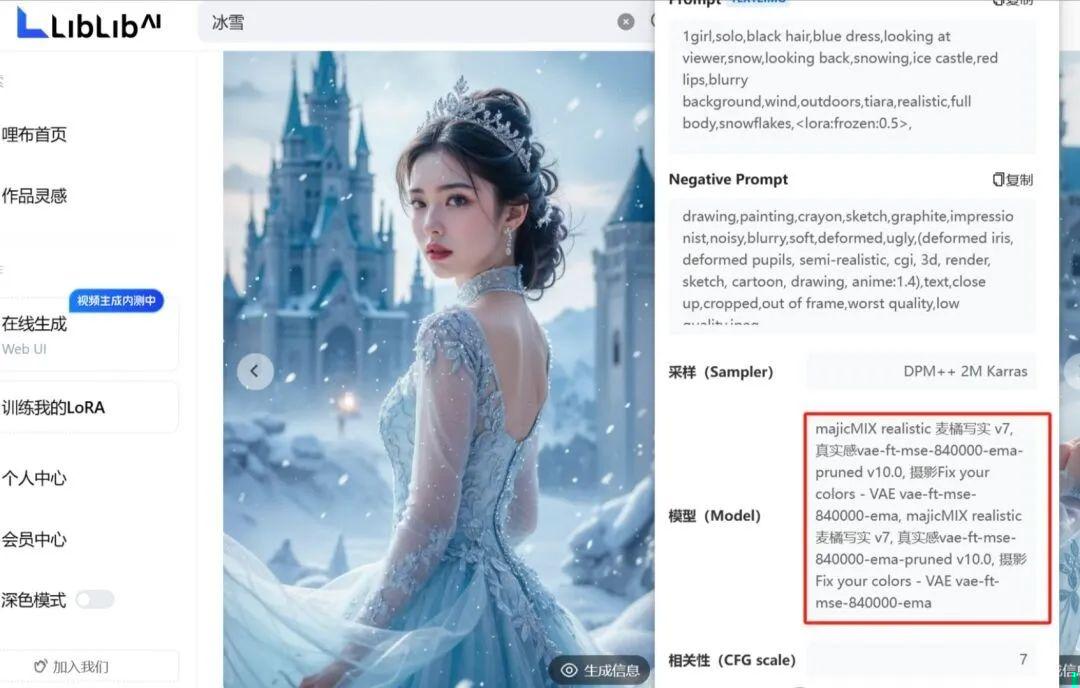

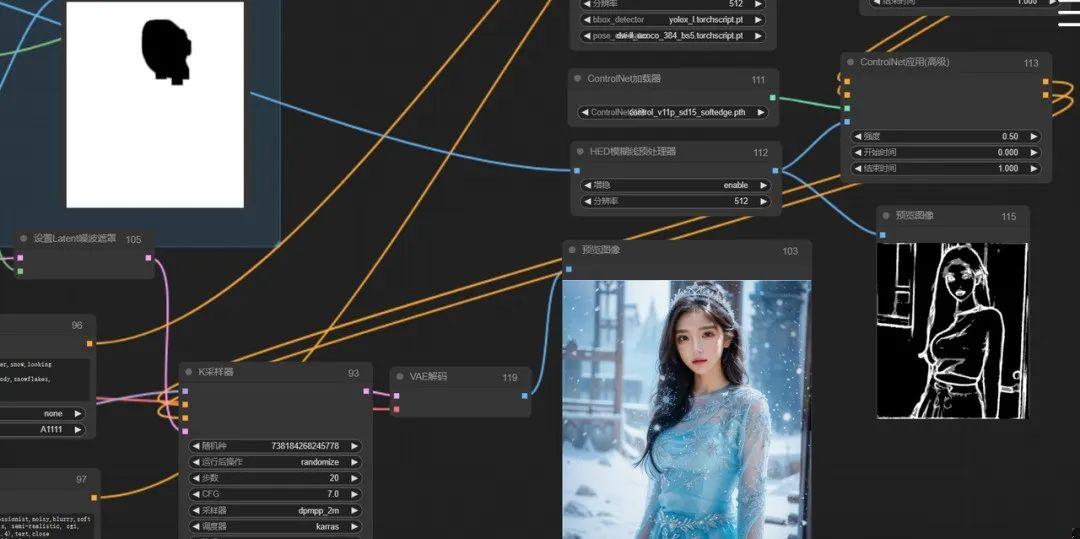

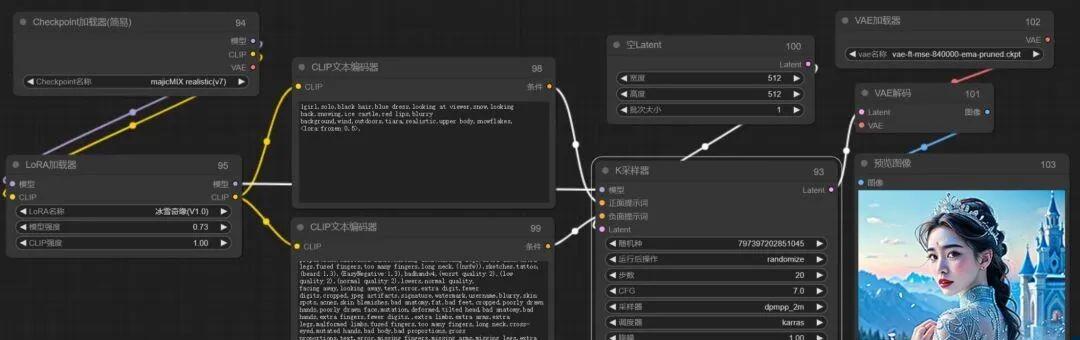

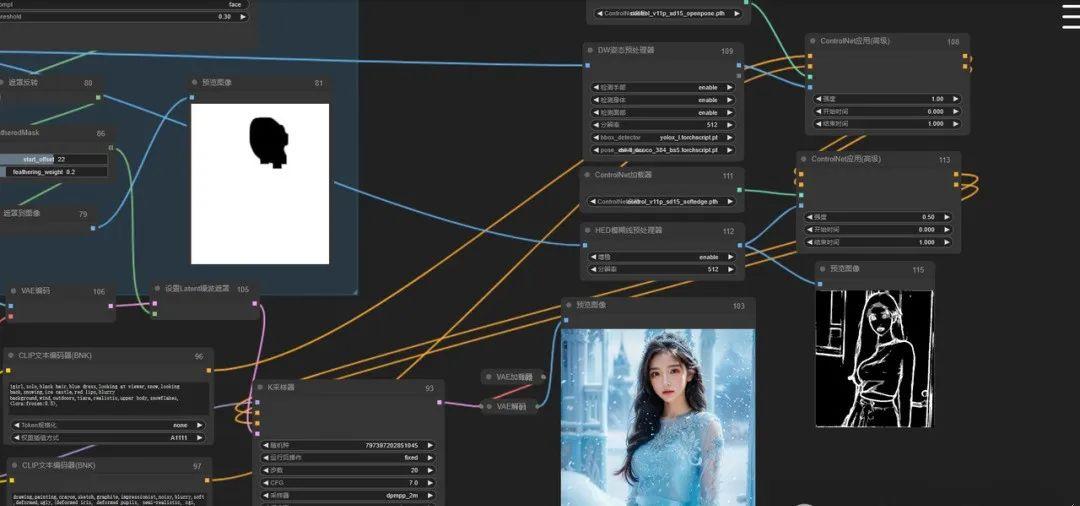

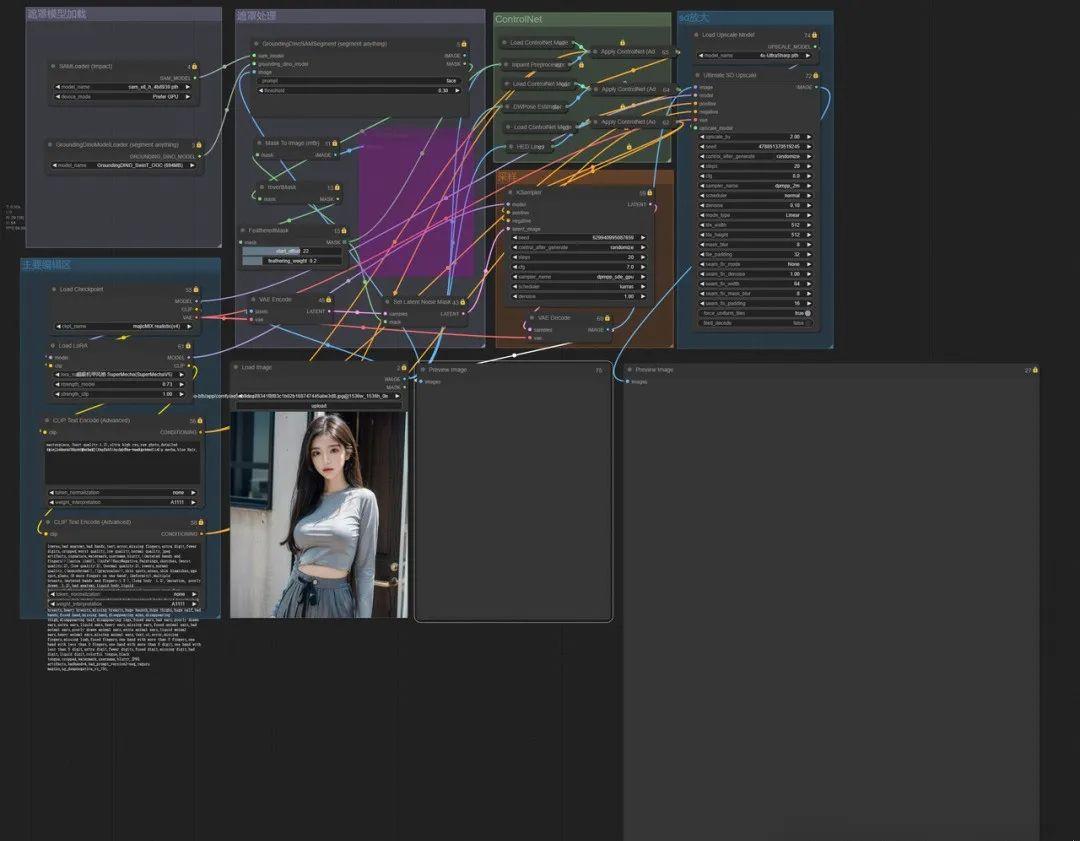

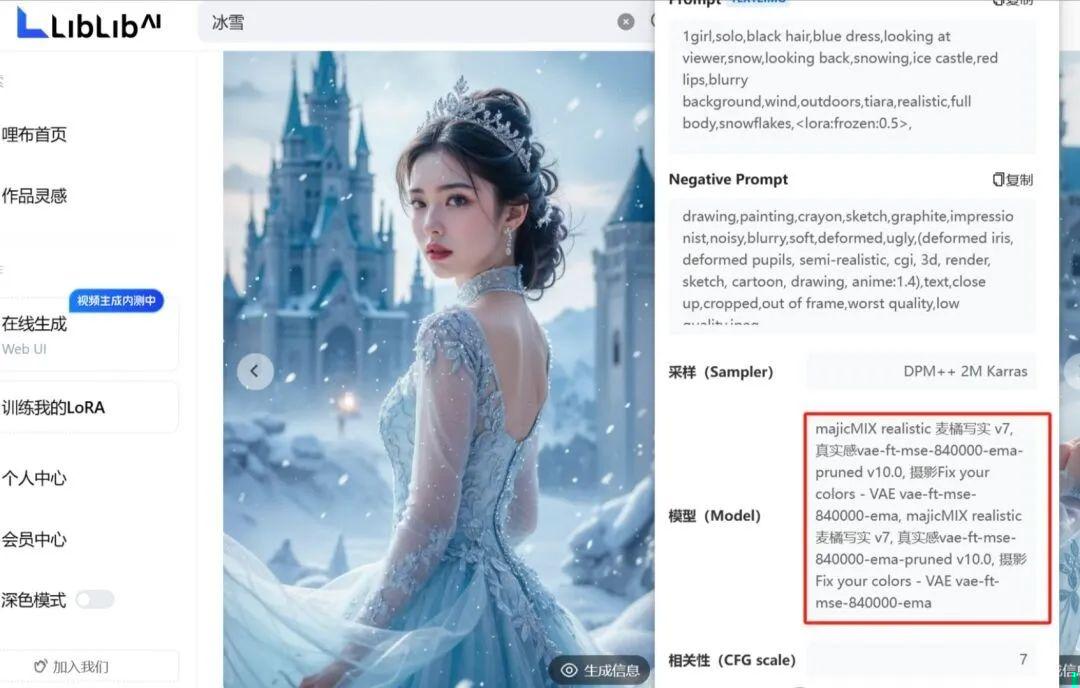

加载对应的大模型和lora,这里主要lora要和大模型相互匹配哦,通过lora模型的说明上可以看到使用什么大模型,如下图,冰雪奇缘这里用的麦橘V7:

这里属于基础部分,我就直接放流程图了,参数调节根据lora模型要求填写即可:

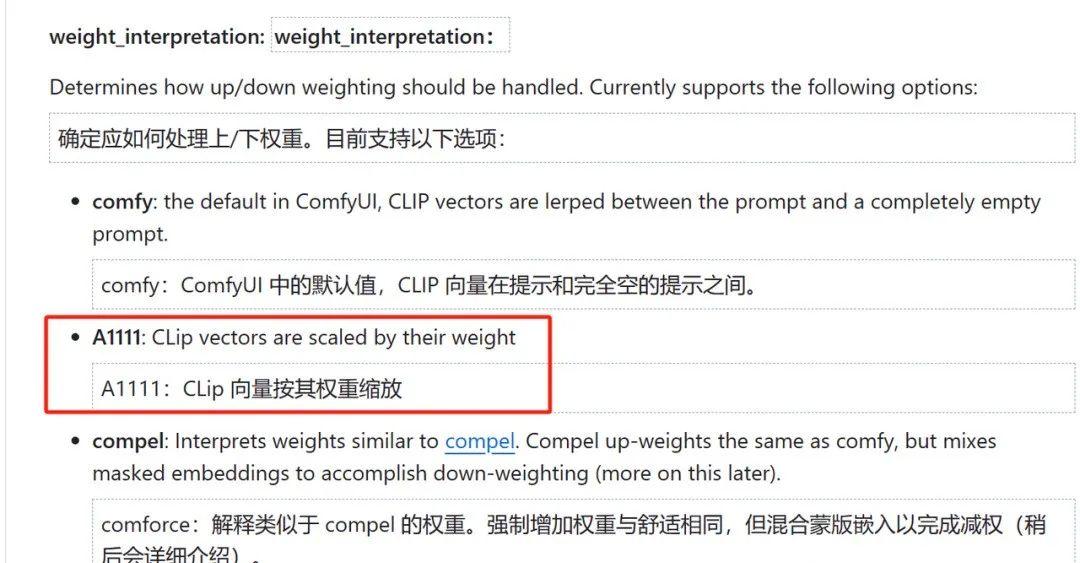

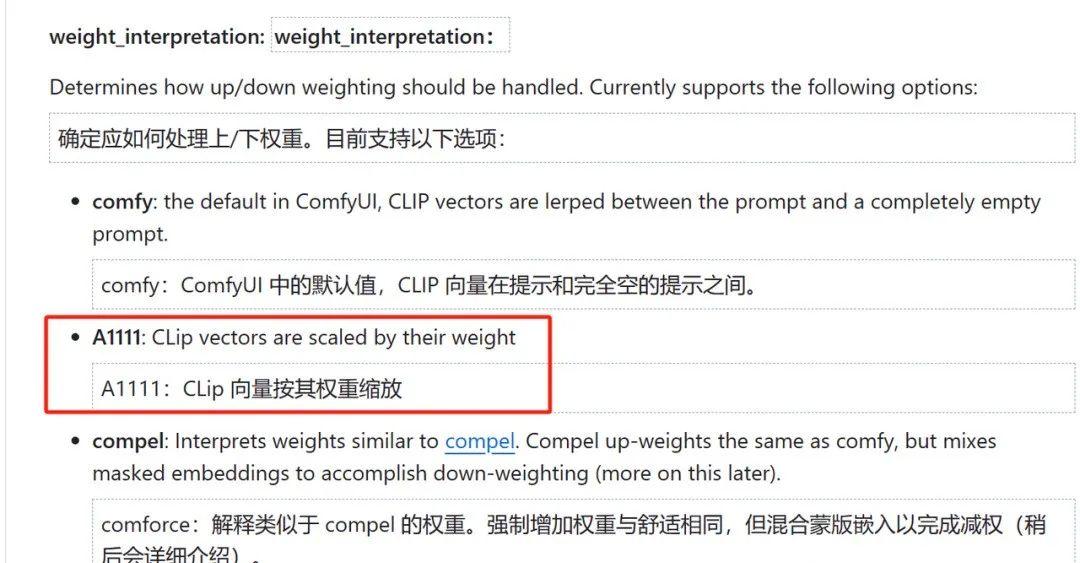

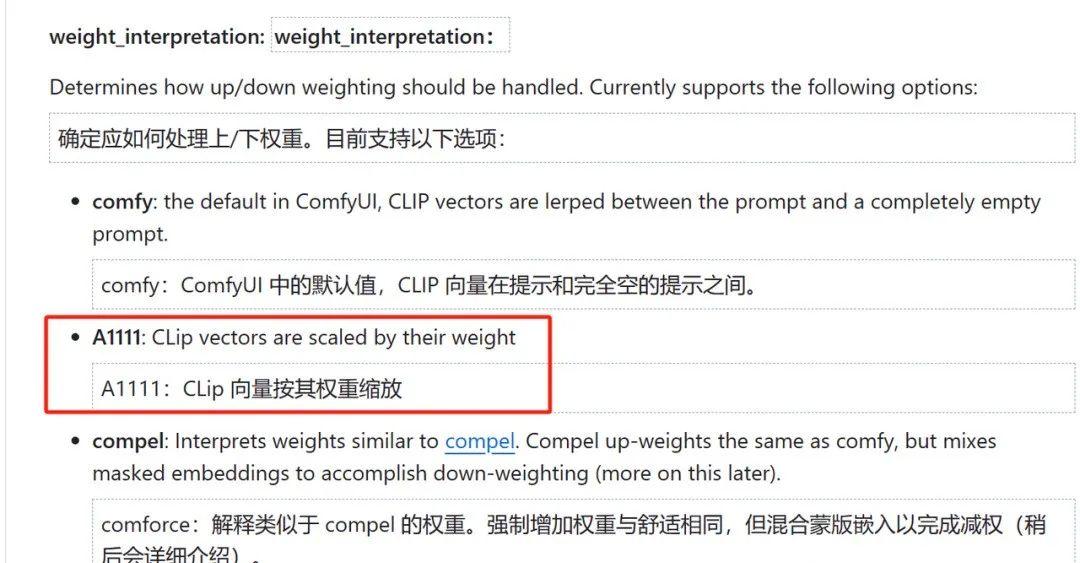

但是!这里依然有有一些细节需要注意,如果我们选择的适用于webui的提示词和参数配置的lora模型,我们需要用webui的提示词权重插值的方法,否则出的图和lora模型的表现有一定的差距。

啥意思呢,讲人话,就是目前大部分lora模型给出的效果图以及提示词都是从webui上得出得结论,但并不一定适用于comfyui,两种方式对提示词编码时的权重插值是有差异的,这也是经常有小伙伴通过ComfyUI还原WebUI时经常发现不能完美还原的一个非常非常重要的原因。

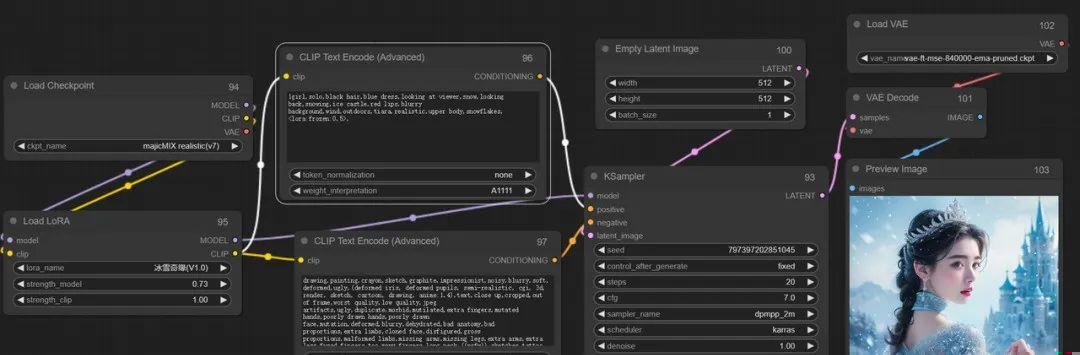

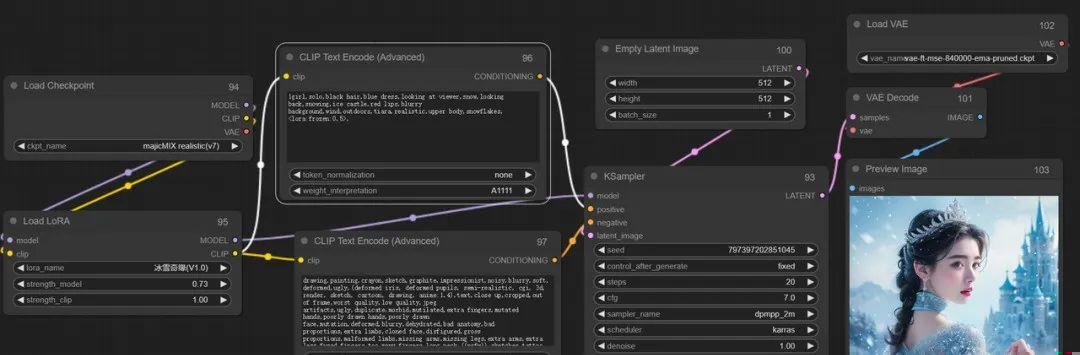

因此为了保证完美还原,这里又引入了一个节点,这个节点允许我们把权重插值方法改为A1111,也就是WebUI的提词权重插值方式,如下图:

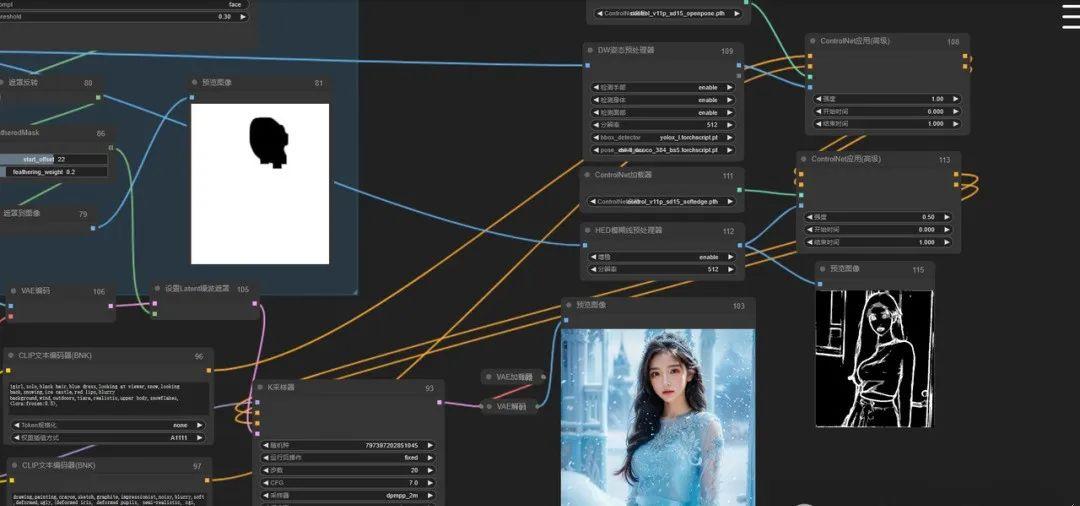

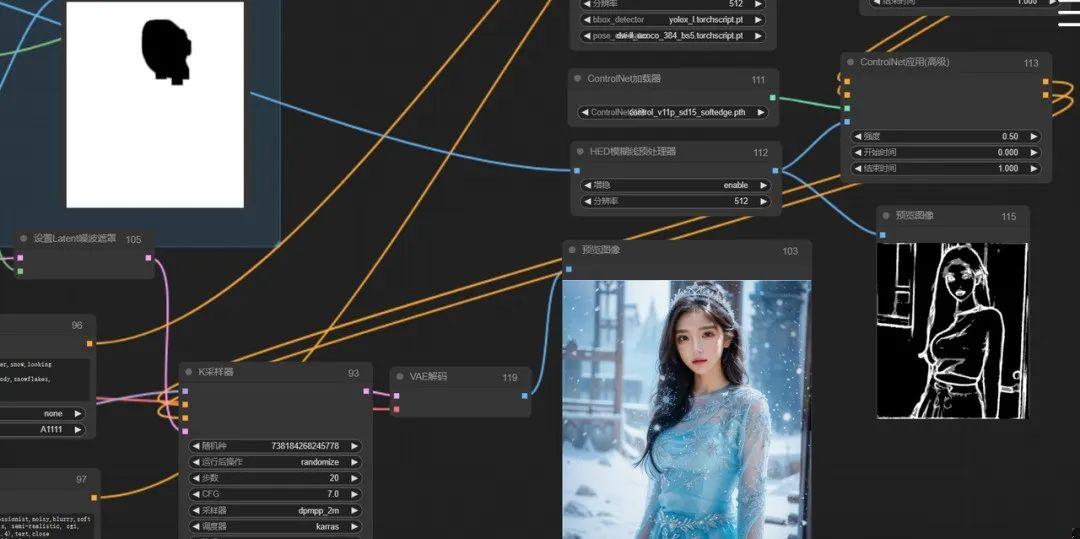

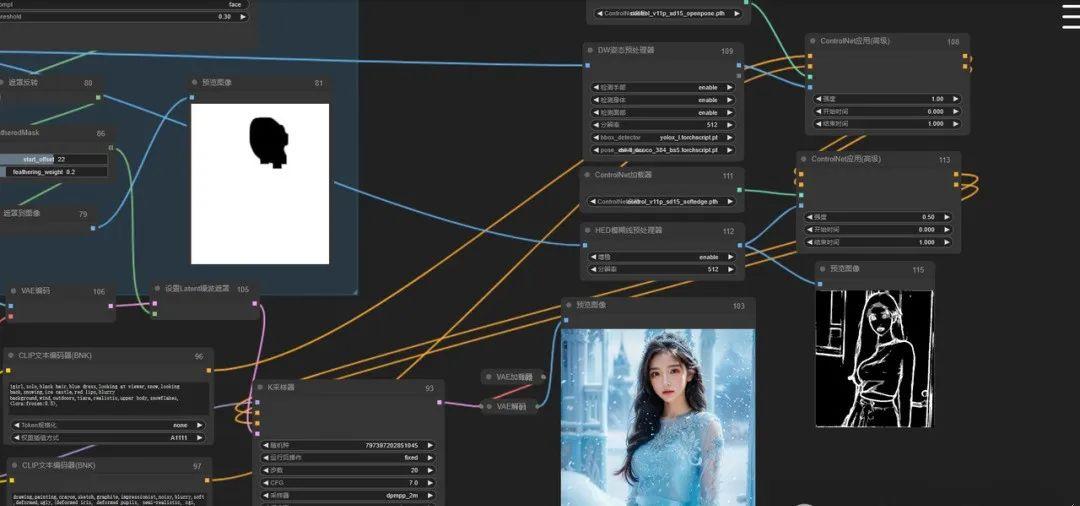

根据上面接上,我们把之前的流程再重新修改,于是如下图:

可以看出两张图是有明显差别的,第一次的图明显锐化比较严重,第二次就好很多了。

到这里,SD基础设置中的前半部分就ok了,后边就是对蒙版内容和现在的采样器进行结合,教程中是重绘非蒙版内容,并且对蒙版区域采用潜空间噪声设置,因此这里需要在潜空间添加噪声以达到比较好的效果,对应ComfyUI可以用设置Latent噪波遮罩,并把图像编码传给采样器一同处理,这里就可以把空latent删除掉啦:

如上图,我们生成测试一下,发现遮罩部分完美把脸部迁移了,背景也重绘了,目前达到我们的效果。

剩下的就交给ControlNet来处理吧。

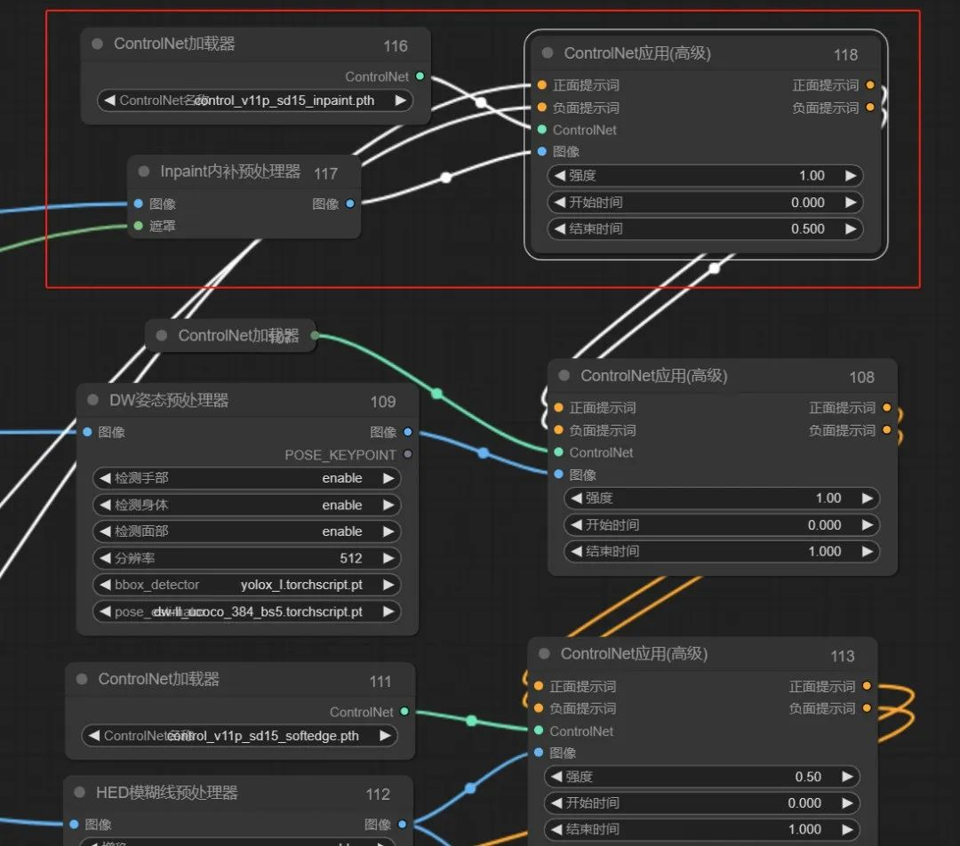

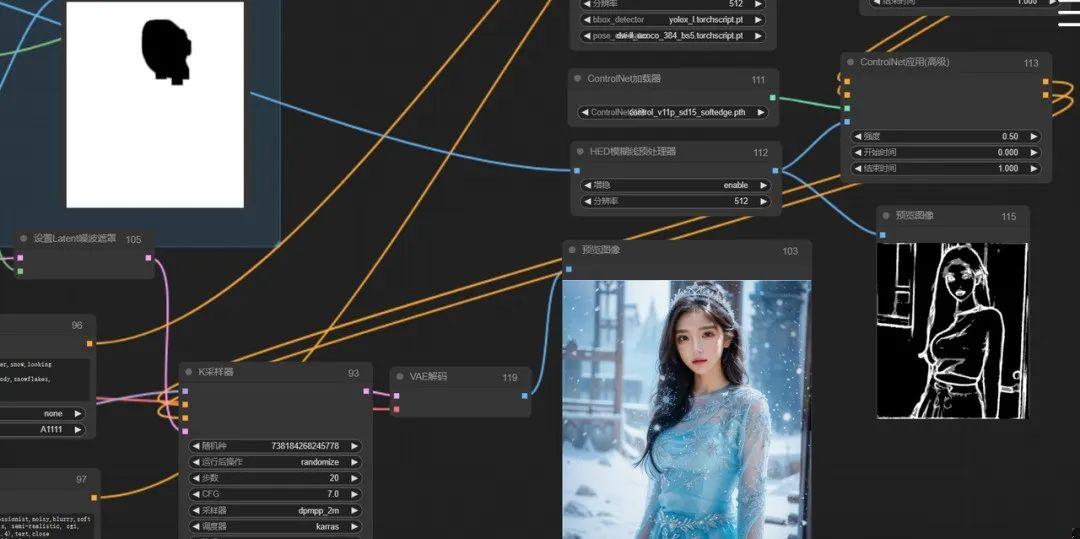

3、ControlNet设置

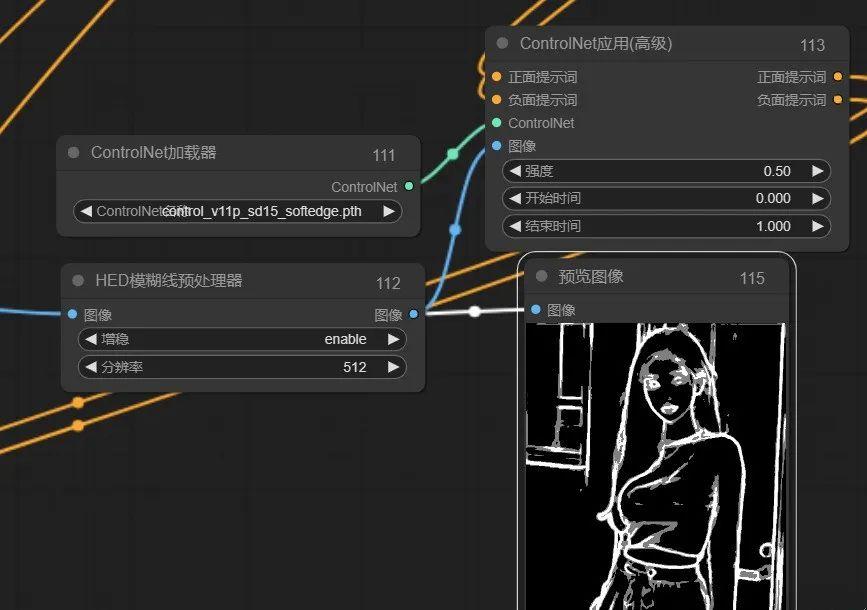

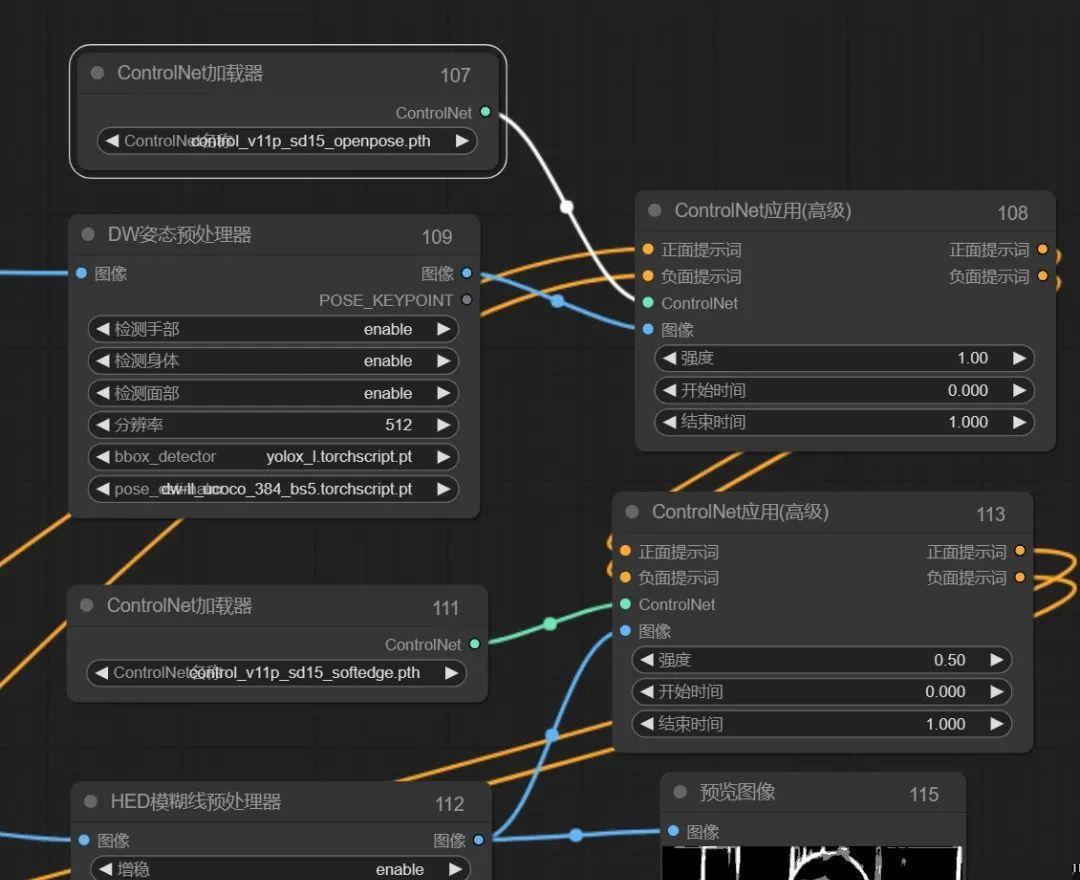

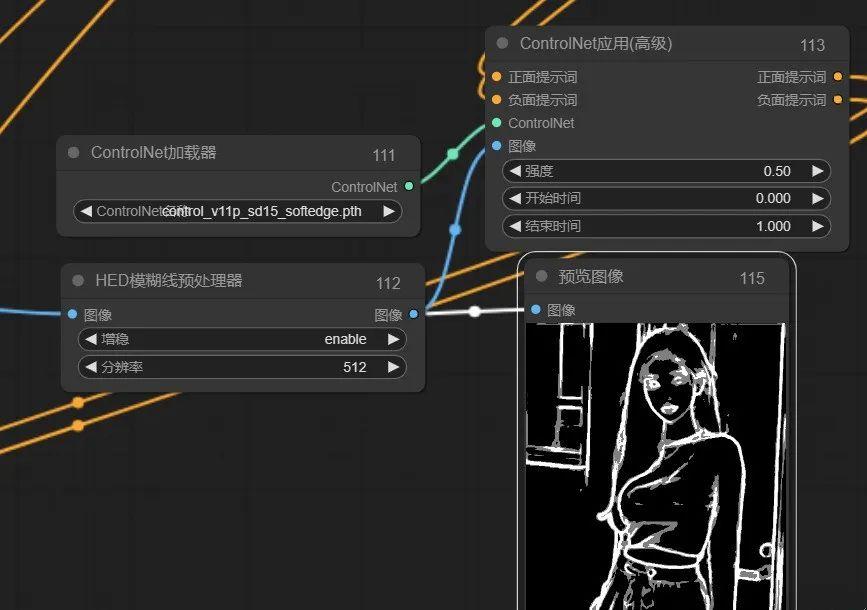

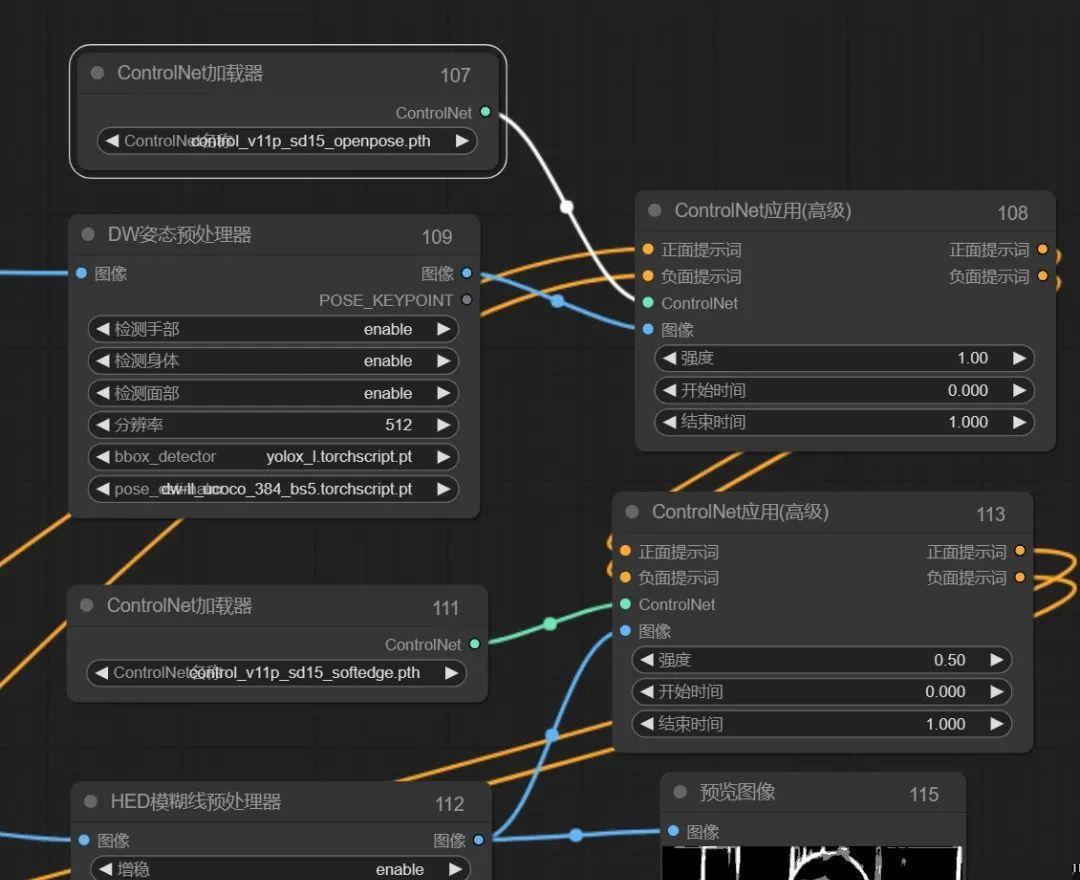

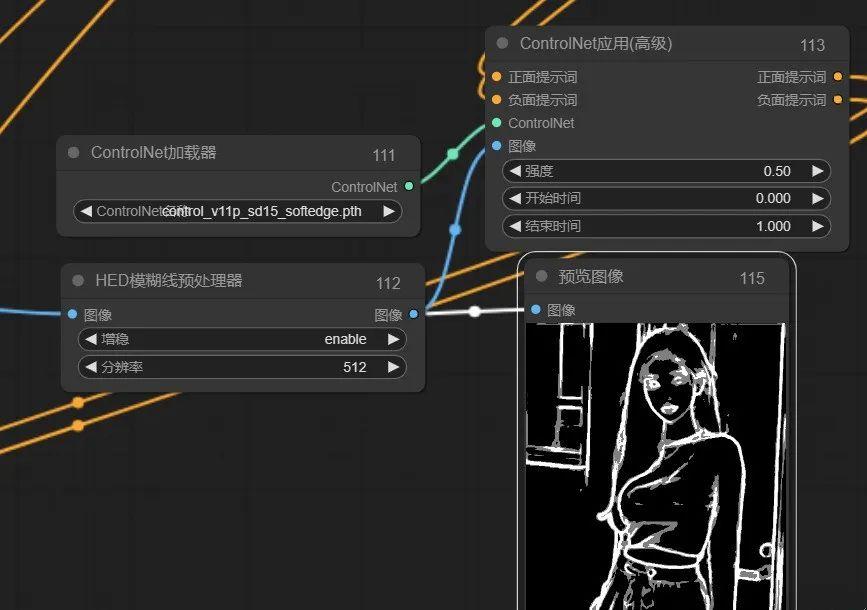

在ControlNet设置的教程里,主要用了openpose和lineart来控制人物的姿态和脸型,且用lineart控制脸部结构时需要手动把多余部分擦出掉。

这部分我想了好久,发现目前没有好的方式实现,但深入思考后,能够发现擦这部分的作用其实是防止衣服和背景的多余线条影响重绘得内容,那我用稍微欠一点的预处理器是不是能行呢,最终用HED模糊线预处理器感觉还凑活,生成的图像并没有太多线条,应该可以用:

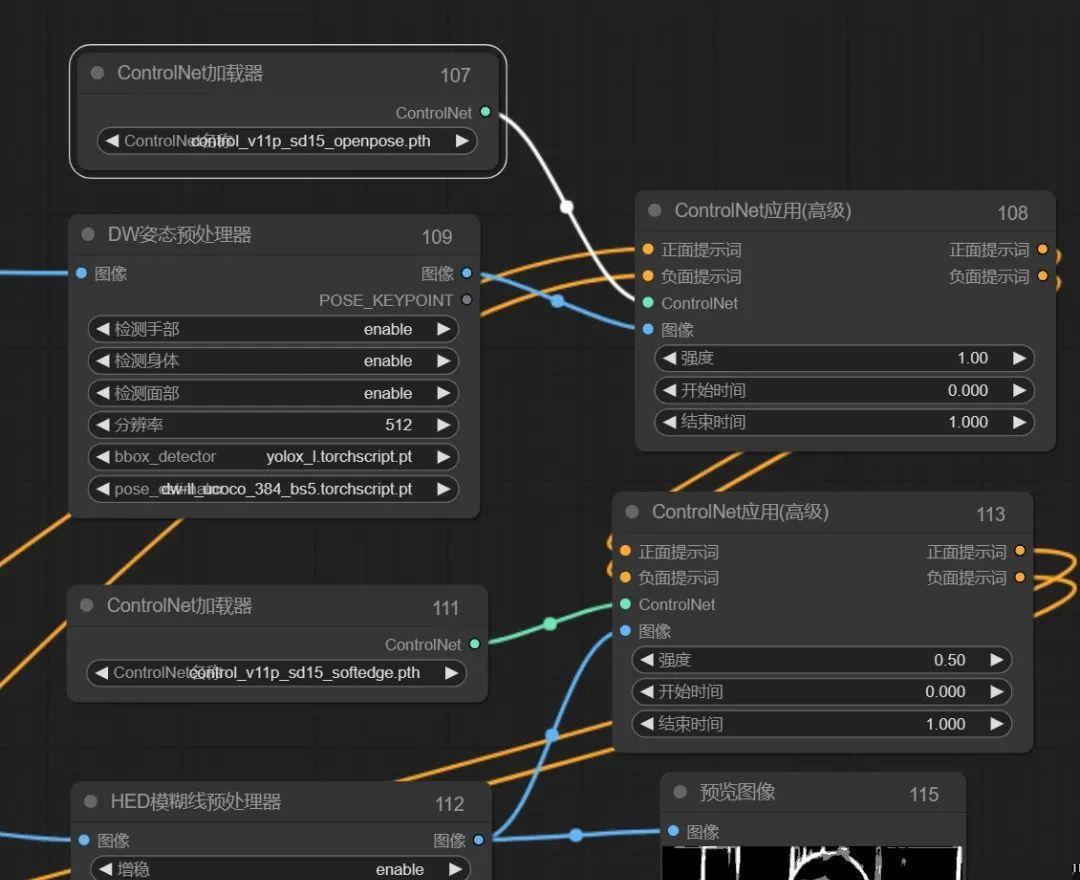

然后加上openpose试一下:

把两个ControlNet串联后接入到采样器就可以啦,先看下生成效果:

看效果感觉用HED还凑活,那就继续。

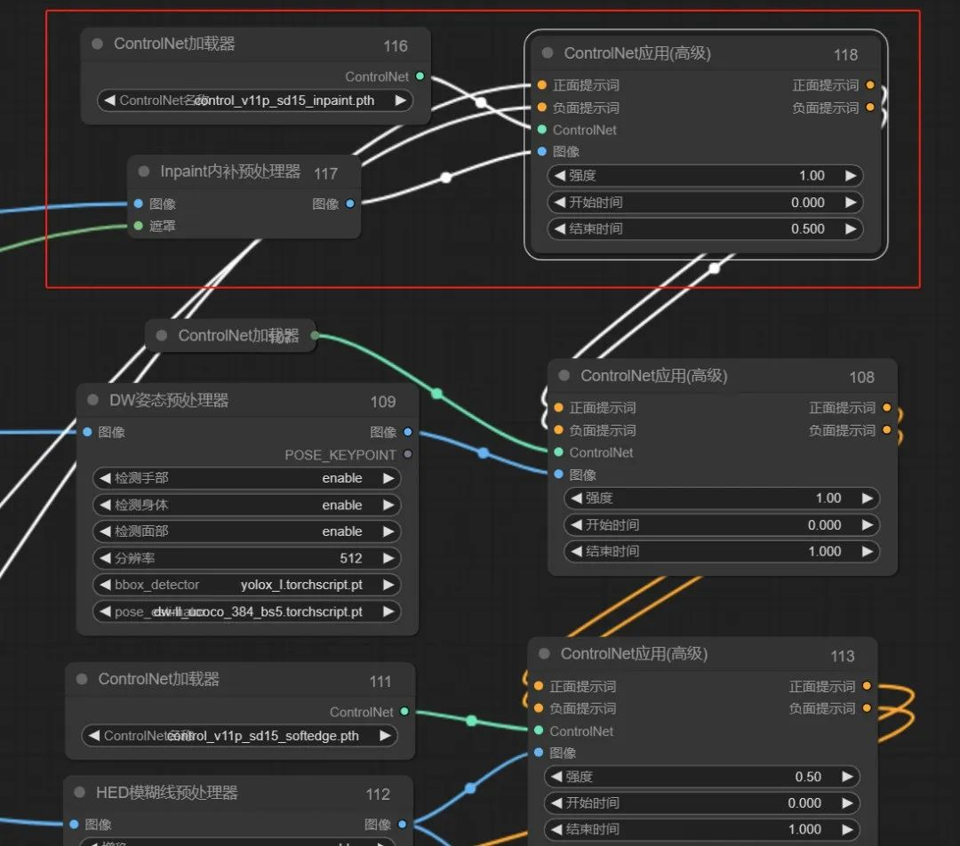

4、修图

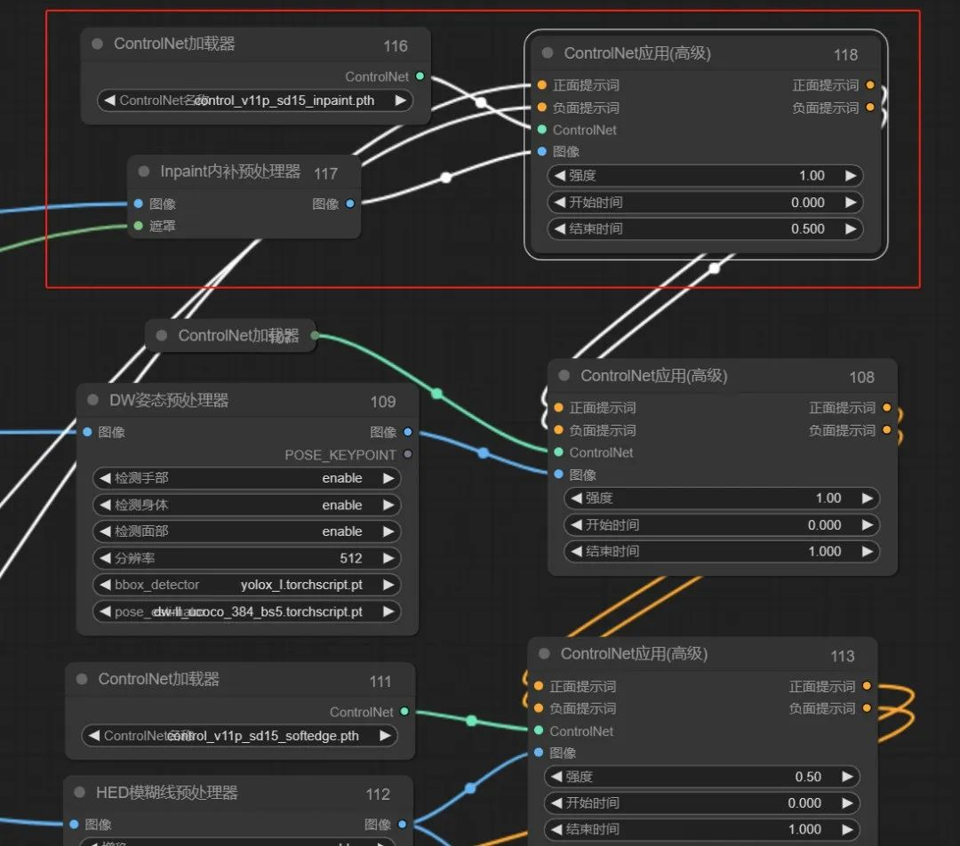

修图主要是对脸部边缘部分进行修复,使其融合的更自然。

教程里用的图生图的局部重绘,这里我们不想用手动去涂抹,ControlNet中有个inpaint预处理器啊,这个玩意也是干这个事得,而且比局部重绘的融合度会稍好一些,我们只需要让其对蒙版和原图的衔接部位进行重绘即可,控制好幅度应该可行。

于是,ControlNet中仍然需要再串联一层inpaint:

如上图,把inpaint串联上去,我们再看下效果吧:

看起来比之前效果确实要好不少。

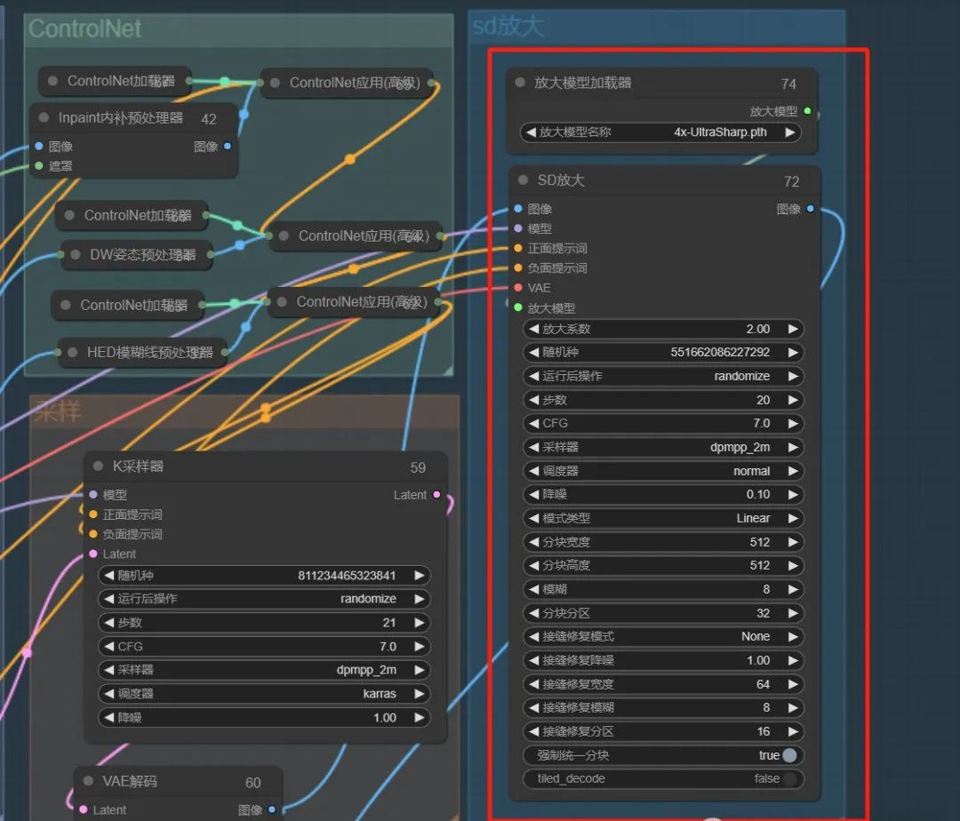

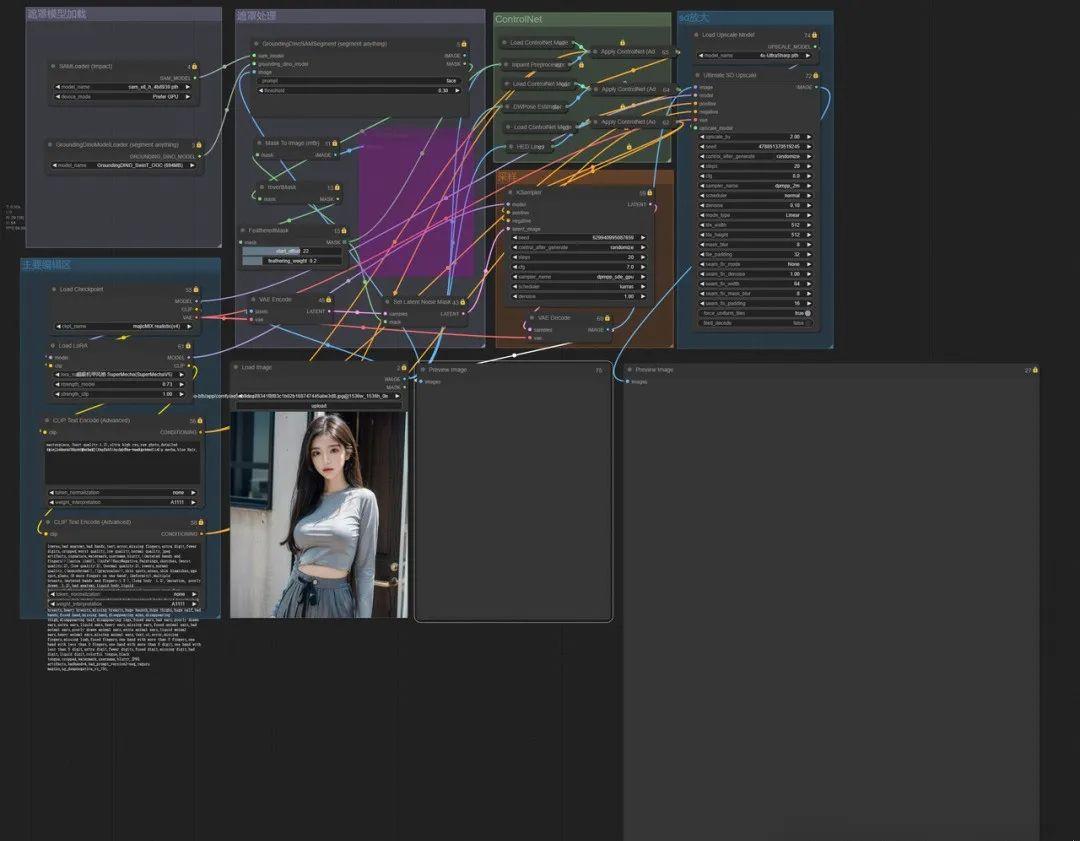

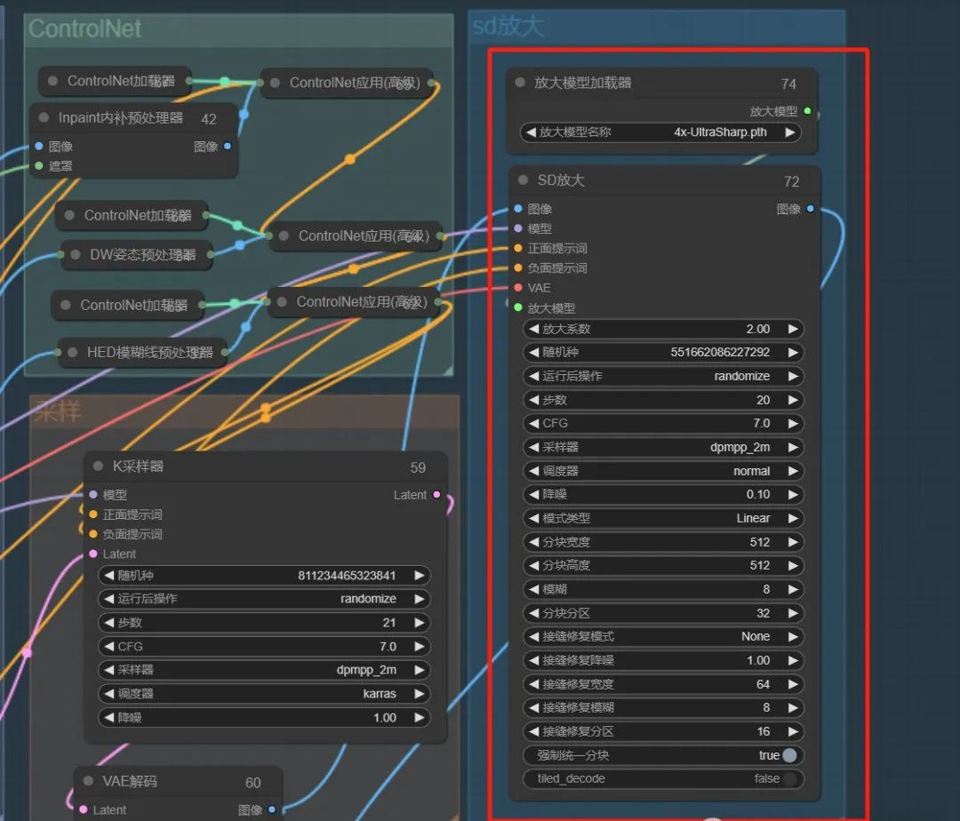

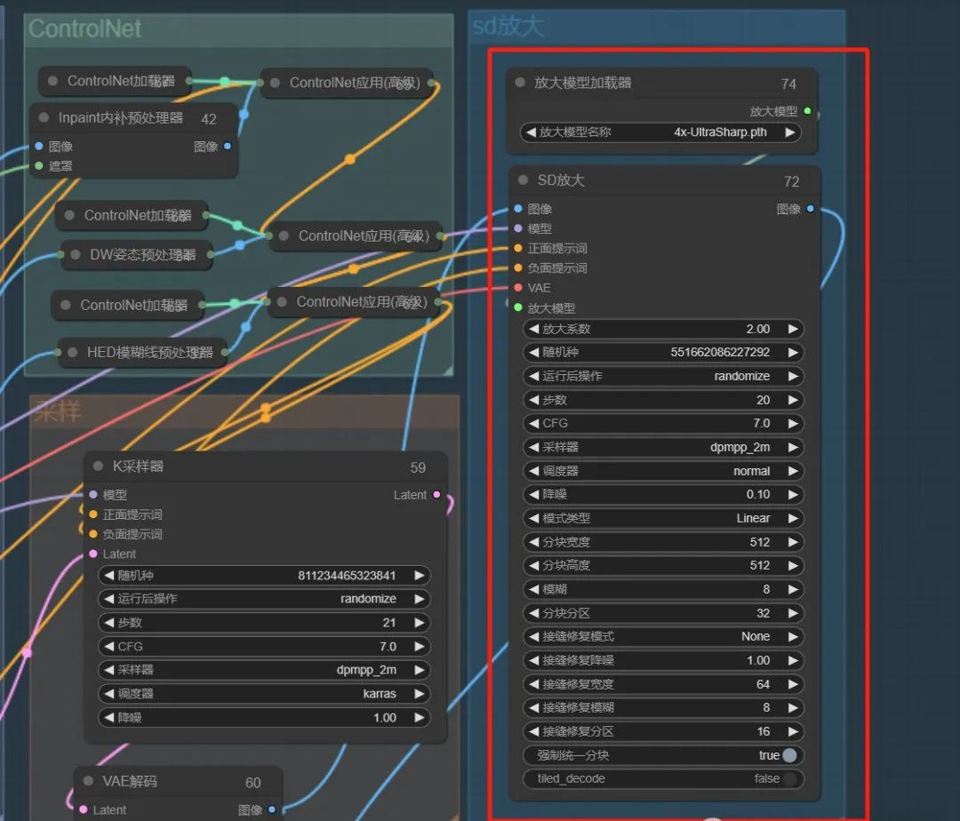

到这里,整个还原就结束了,为了更清晰的划分不同模块,并做下后期放大,后面篇幅增加了放大功能。

二、后期优化

原图质量越好,生成的图也会越好,但大部分可能原图像素比较低,这里可以通过工作流直接组合放大功能。

这里我只用了SD放大,大家可以参考上面的文章,把图像放大到合适的大小哦。

可以看到图像被放大后还是很清晰的,并且经过重采样后,融合度可以说是完美。

但经过重采样的放大的图像会和原图略有区别,就和美颜后一样,这个可以通过调节降噪幅度自行调节到自己想要的程度。(ps: 效果是不是类似于插件instantid换脸法呢,嘿嘿!当然通过instantid换脸通过comfyui是比较容易做到的,属于比较基础的部分啦,小伙伴感兴趣的可以自己去实验吧)

为了方便查看,我对节点做了少许整理,并对刚才的分布制作单独分组,方便大家分块学习。

下面的两个图片和一个Json文件选取一个导入comfyui中即可展示全部流程了。

AI写真变现项目,新书小白也能轻松上手的保姆级教程(建议收藏)

newsman 发表了文章 • 2024-03-22 09:19

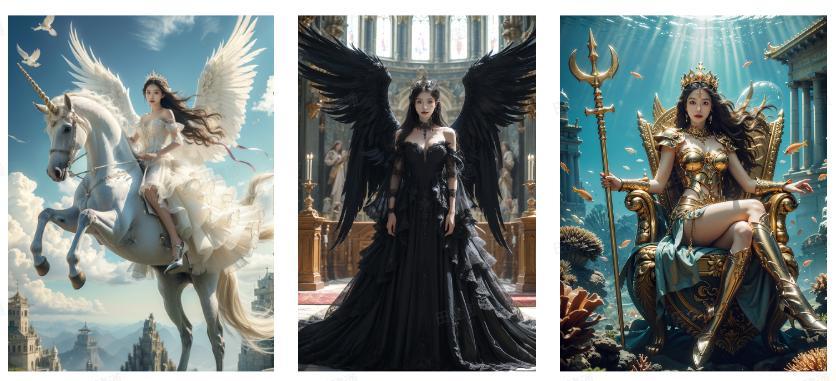

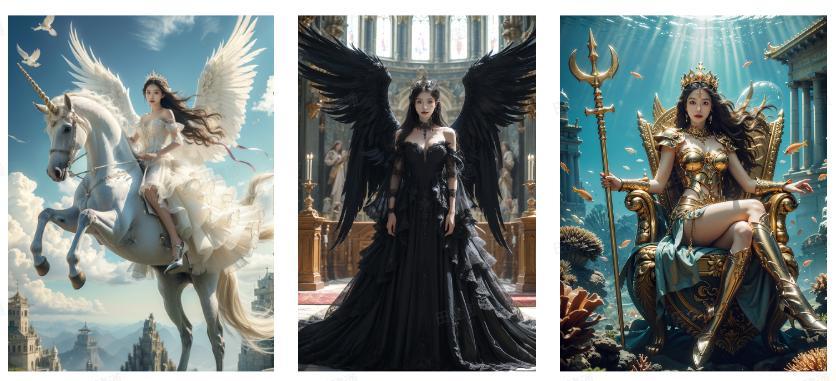

在介绍这个项目之前要先让你看看AI写真项目的作品成品,觉得不错有市场,有人愿意买单,你再继续往下看,否则划走就行。

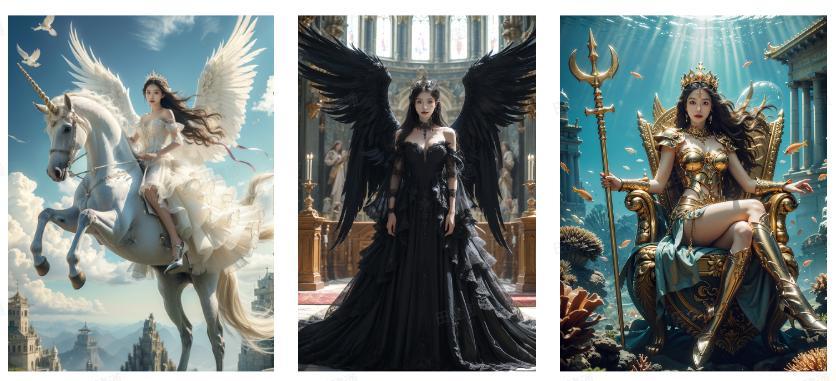

案例效果展示

不止是小孩,成年女生的也可以,以往如果要拍出一套写真,要布景,妆造,拍摄,修图等等一套流程,而现在用AI,只需要2分钟就可以出来:

白衣天使和黑暗女王,海皇都可以,可以说只有你想不到的,没有她做不到:

除了女生之外,针对宝妈的小孩AI写真也是重中之重:

这个是小孩的原图,然后我们可以做成龙年写真,或者这样很帅的机甲风,小小魔法师等

变现机会分析

生活赋能

说实话,学会这项技能自己用或者在朋友圈炫一下已经很值了。

如果你是学生,帮自己、或者同学、女朋友、家人做一组这样的AI写真,无论是生日礼物,还是拿来泡妞搏女神一笑,还是就做完发朋友圈装逼,都会获得很高的点赞量。

如果你是女孩子或者宝妈,帮自己和自己的孩子,或者好闺蜜,朋友,同事做一套AI写真,这是多好的一件事情。

熟悉我的朋友都知道,通常来说我只会推荐我认为真正有价值的项目,AI写真就是一个除了变现以外还非常有价值的项目,再怎么样学会了这样一项技能后,都能帮自己在日常生活中用起来,这个就是我们普通人通过运用AI帮助自己的生活变得更好的例子。

副业变现

第二个价值就是变现,AI写真目前在市面上需求还远远没有被满足,是一个很好的入场机会,现在这套技术几乎是市面上最具竞争力的,不仅可以做到质量很高,而且学习成本不高。

目前市面上那些要做得很好的,都要本身有比较强的PS技术来调整,这一项目做到了让用户不需要学习PS就能做出90分的效果。

为什么AI写真现在是一个很好的变现项目?

判断一个项目是否可行,一定是从需求开始分析

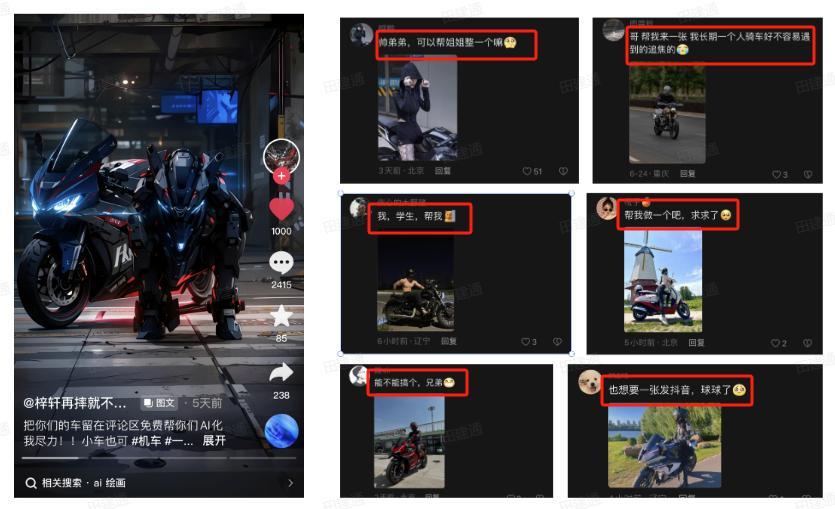

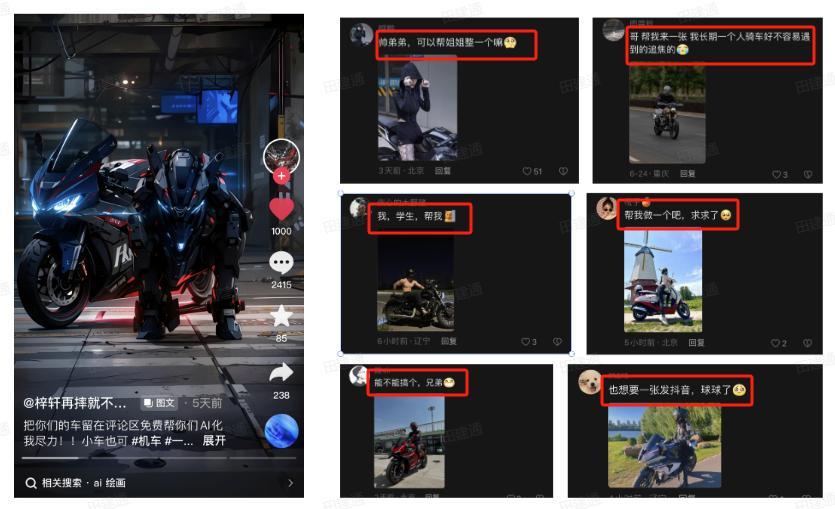

如果是一些大的项目,你需要自己去做MVP测试需求是否真实?

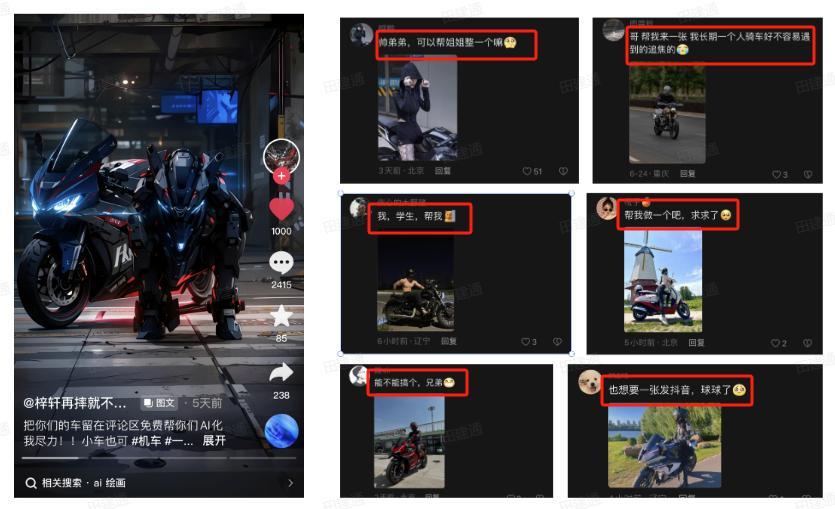

如果是比较小的项目,通常只需要去找到异常值就好了。

比如之前赛博机车的时候,别人一条内容的点赞只有1000,但评论却有2000多,同时评论区里的评论绝大多数都是这种有制作意愿的需求:

你再去想需求的群体是谁?是机车一族,他们本就是喜欢这些酷炫的东西,并愿意为之付费。

所以AI赛博机车图就正好符合这类人群需求,所以整个变现合理性一说出来,你能感觉到是通的。

那现在来看看AI写真项目:

你有一天刷小红书的时候,发现了下面的异常值:

一个480赞的内容,有157条评论,且更为重要的是,评论区都是需求,且都是已经明说要付费的需求。

这里的写真有女生自己想做的AI写真,也有宝妈想给宝宝做的AI写真,无一例外,女生、宝妈,都是非常有付费能力的群体,尤其是在小红书这样的平台上,更愿意为自己或者孩子付费。

同时写真这个产品的属性就意味着价格不会太低,外面自己去写真馆拍一套写真都要几百了,做一个AI写真,一张大几十也很合理。

希望你能通过这个项目真正赚到钱,无论是第一桶金也好,还是找到自己的副业方向都很值。

链接成长

首先自己的AI技术,SD也好,MJ也好,如果你之前一直没学会,你跟着教程和社群完整的操作实践下来,这块的技能就补上了。

同时你还会学会互联网项目的玩法,知道怎么做内容,怎么引流私域变现,积累这块的能力,以及你可以在群里和各路大神交流,互相学习、深度链接。

适合人群

①有执行力,愿意主动克服困难

②电脑设备有足够的配置支持,如果配置不够也愿意用云平台操作

③有准备好的小红书账号、抖音账号以及微信号,支持公域做内容

电脑配置

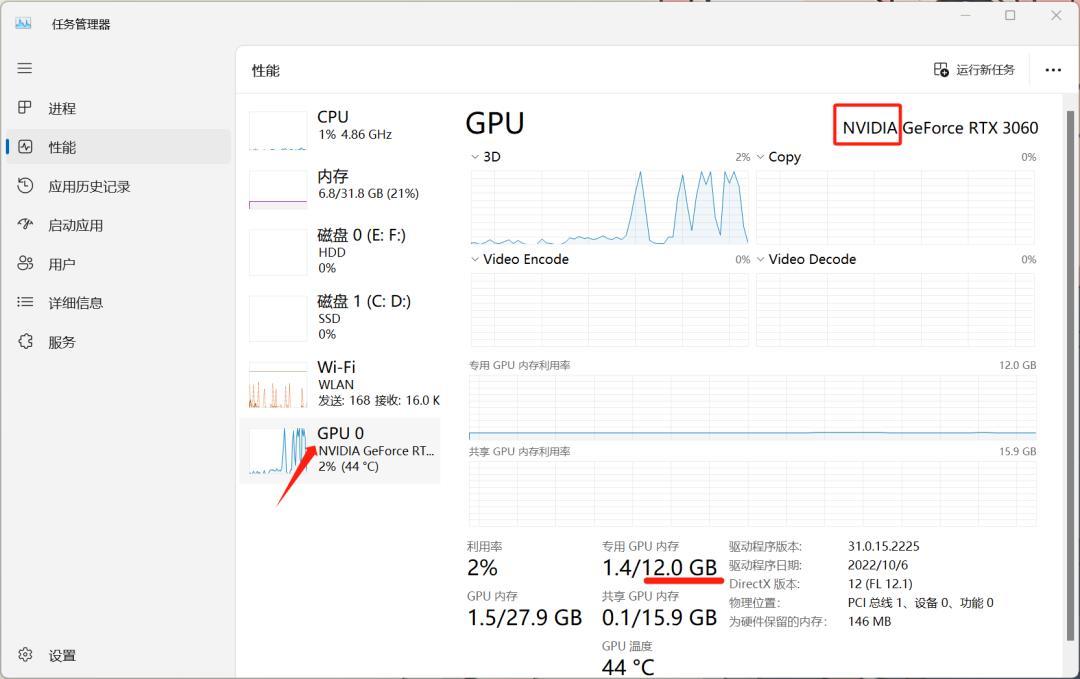

使用SD对电脑配置有一定的要求,为了后续大家能够更加顺利的使用SD,我们可以先检查一下自己的电脑配置。

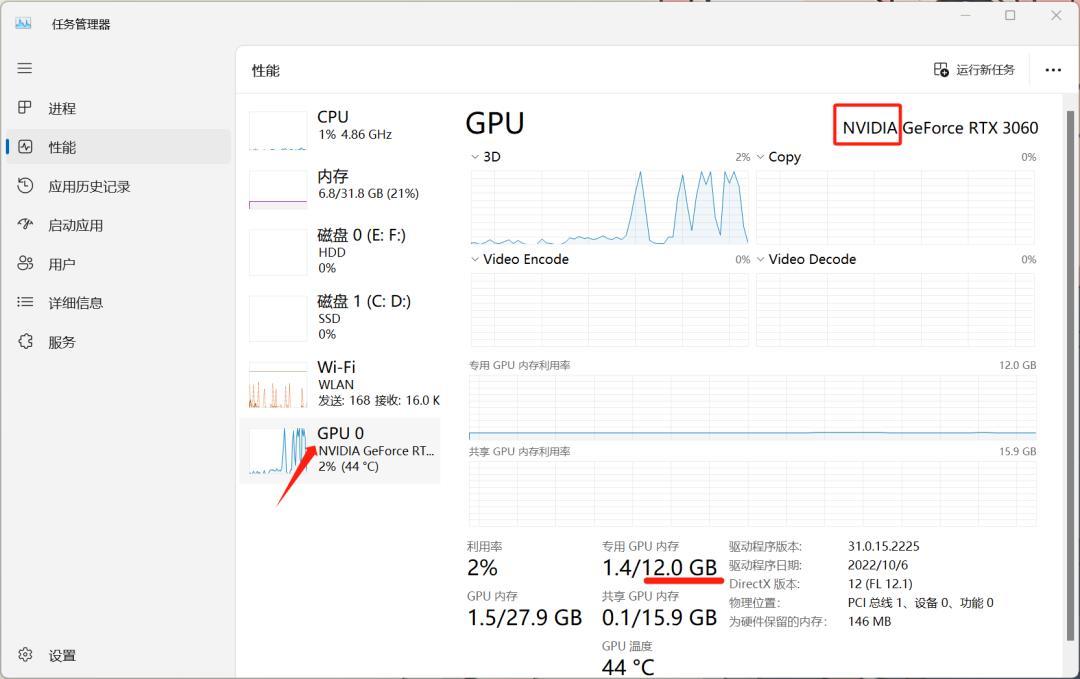

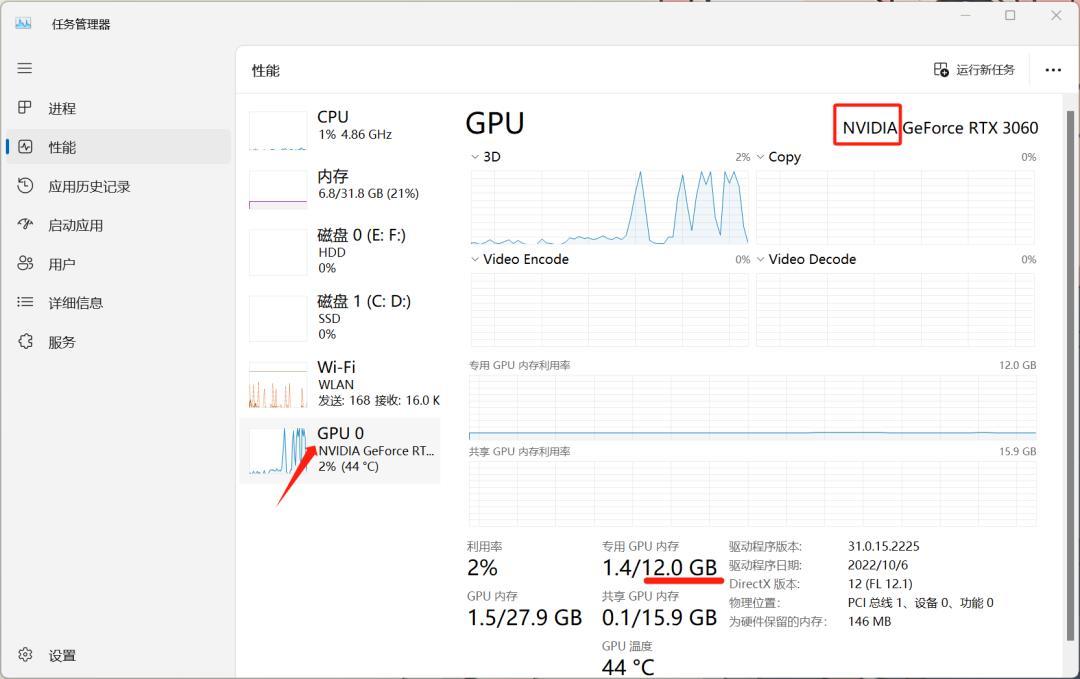

首先,我们电脑分为Mac系统和Win系统,其中Win系统的显卡又分为N卡和A卡

这里我们Win系统的N卡,是最适合玩SD的,无论是最新的插件还是功能更新,N卡都是最快最适配的。

如果是Mac系统或者A卡的情况下,使用sd会比较容易出现报错,或者缺少某个功能,即便是Win系统的N卡,我们还要考虑电脑运行内存,和显卡内存的大小:

电脑运行内存推荐8GB以上

显卡的内存,也就是显存,需要在8GB以上

总结一下,就是Win系统N卡,运行内存8GB以上,显存8GB以上,可以在自己电脑下载软件。

Mac系统、A卡、以及电脑配置不太行的,就可以选择云平台,云电脑,相当于租用别人更高配置的电脑来使用SD

检查电脑配置操作流程

①首先鼠标右键点击桌面底部任务栏,打开任务管理器

②看到性能里面的内存,后面这个数字就是我们电脑的运行内存,也就是图片中划线的数字

这个内存如果显示的是8GB,那就说明你的电脑刚好达到使用SD的标准

③点击GPU,先看右上角的第一个单词

如果是“NVIDIA”就代表是N卡

如果是AMD就是A卡

接着看到下面专用GPU内存,后面的数字就是我们电脑的显存

显存需要在8GB以上,用SD出图才会比较顺畅

大家就按照自己电脑的实际情况,选择是在自己电脑本地下载软件,还是租用云平台。

AI写真项目拆解,手把手教学新手教程,ComfyUI版

Overseas 发表了文章 • 2024-03-22 10:23

一、分步制作

根据写真的SOP教程,蒙版变装的方法分为了四部分:

1、制作蒙版2、SD基础设置3、ControlNet设置4、修图

1、制作蒙版

根据教程中显示,制作蒙版是把脸部蒙版精准抠出,我们需要通过分割算法把脸部自动抠出,这里用到可以分割一切的seg(segment anything)

比葫芦画瓢,于是,小姐姐的脸完美扣出来了:

但在后期所有步骤连成后,发现遮罩边缘部分衔接不是太好,查了部分资料,发现是遮罩边缘太锋利导致,于是此处流程仍需要对蒙版边缘做羽化处理,核心节点就有,但试了一下,边缘依然比较清晰,发现核心节点feather mask是对整个图进行羽化,这不是我们想要的,我们只想对脸部进行羽化,这里用的是FeatheredMask节点。

通过FeatheredMask节点完美实现对边缘的羽化处理,如下图可以看到边缘明显不那么锐利:

到这里,第一步制作蒙版基本就达到我们想要的效果了。

2、SD基础设置

玩过ComfyUI的同学,相信这一步应该非常熟练的还原教程。

加载对应的大模型和lora,这里主要lora要和大模型相互匹配哦,通过lora模型的说明上可以看到使用什么大模型,如下图,冰雪奇缘这里用的麦橘V7:

这里属于基础部分,我就直接放流程图了,参数调节根据lora模型要求填写即可:

但是!这里依然有有一些细节需要注意,如果我们选择的适用于webui的提示词和参数配置的lora模型,我们需要用webui的提示词权重插值的方法,否则出的图和lora模型的表现有一定的差距。

啥意思呢,讲人话,就是目前大部分lora模型给出的效果图以及提示词都是从webui上得出得结论,但并不一定适用于comfyui,两种方式对提示词编码时的权重插值是有差异的,这也是经常有小伙伴通过ComfyUI还原WebUI时经常发现不能完美还原的一个非常非常重要的原因。

因此为了保证完美还原,这里又引入了一个节点,这个节点允许我们把权重插值方法改为A1111,也就是WebUI的提词权重插值方式,如下图:

根据上面接上,我们把之前的流程再重新修改,于是如下图:

可以看出两张图是有明显差别的,第一次的图明显锐化比较严重,第二次就好很多了。

到这里,SD基础设置中的前半部分就ok了,后边就是对蒙版内容和现在的采样器进行结合,教程中是重绘非蒙版内容,并且对蒙版区域采用潜空间噪声设置,因此这里需要在潜空间添加噪声以达到比较好的效果,对应ComfyUI可以用设置Latent噪波遮罩,并把图像编码传给采样器一同处理,这里就可以把空latent删除掉啦:

如上图,我们生成测试一下,发现遮罩部分完美把脸部迁移了,背景也重绘了,目前达到我们的效果。

剩下的就交给ControlNet来处理吧。

3、ControlNet设置

在ControlNet设置的教程里,主要用了openpose和lineart来控制人物的姿态和脸型,且用lineart控制脸部结构时需要手动把多余部分擦出掉。

这部分我想了好久,发现目前没有好的方式实现,但深入思考后,能够发现擦这部分的作用其实是防止衣服和背景的多余线条影响重绘得内容,那我用稍微欠一点的预处理器是不是能行呢,最终用HED模糊线预处理器感觉还凑活,生成的图像并没有太多线条,应该可以用:

然后加上openpose试一下:

把两个ControlNet串联后接入到采样器就可以啦,先看下生成效果:

看效果感觉用HED还凑活,那就继续。

4、修图

修图主要是对脸部边缘部分进行修复,使其融合的更自然。

教程里用的图生图的局部重绘,这里我们不想用手动去涂抹,ControlNet中有个inpaint预处理器啊,这个玩意也是干这个事得,而且比局部重绘的融合度会稍好一些,我们只需要让其对蒙版和原图的衔接部位进行重绘即可,控制好幅度应该可行。

于是,ControlNet中仍然需要再串联一层inpaint:

如上图,把inpaint串联上去,我们再看下效果吧:

看起来比之前效果确实要好不少。

到这里,整个还原就结束了,为了更清晰的划分不同模块,并做下后期放大,后面篇幅增加了放大功能。

二、后期优化

原图质量越好,生成的图也会越好,但大部分可能原图像素比较低,这里可以通过工作流直接组合放大功能。

这里我只用了SD放大,大家可以参考上面的文章,把图像放大到合适的大小哦。

可以看到图像被放大后还是很清晰的,并且经过重采样后,融合度可以说是完美。

但经过重采样的放大的图像会和原图略有区别,就和美颜后一样,这个可以通过调节降噪幅度自行调节到自己想要的程度。(ps: 效果是不是类似于插件instantid换脸法呢,嘿嘿!当然通过instantid换脸通过comfyui是比较容易做到的,属于比较基础的部分啦,小伙伴感兴趣的可以自己去实验吧)

为了方便查看,我对节点做了少许整理,并对刚才的分布制作单独分组,方便大家分块学习。

下面的两个图片和一个Json文件选取一个导入comfyui中即可展示全部流程了。

AI写真变现项目,新书小白也能轻松上手的保姆级教程(建议收藏)

newsman 发表了文章 • 2024-03-22 09:19

在介绍这个项目之前要先让你看看AI写真项目的作品成品,觉得不错有市场,有人愿意买单,你再继续往下看,否则划走就行。

案例效果展示

不止是小孩,成年女生的也可以,以往如果要拍出一套写真,要布景,妆造,拍摄,修图等等一套流程,而现在用AI,只需要2分钟就可以出来:

白衣天使和黑暗女王,海皇都可以,可以说只有你想不到的,没有她做不到:

除了女生之外,针对宝妈的小孩AI写真也是重中之重:

这个是小孩的原图,然后我们可以做成龙年写真,或者这样很帅的机甲风,小小魔法师等

变现机会分析

生活赋能

说实话,学会这项技能自己用或者在朋友圈炫一下已经很值了。

如果你是学生,帮自己、或者同学、女朋友、家人做一组这样的AI写真,无论是生日礼物,还是拿来泡妞搏女神一笑,还是就做完发朋友圈装逼,都会获得很高的点赞量。

如果你是女孩子或者宝妈,帮自己和自己的孩子,或者好闺蜜,朋友,同事做一套AI写真,这是多好的一件事情。

熟悉我的朋友都知道,通常来说我只会推荐我认为真正有价值的项目,AI写真就是一个除了变现以外还非常有价值的项目,再怎么样学会了这样一项技能后,都能帮自己在日常生活中用起来,这个就是我们普通人通过运用AI帮助自己的生活变得更好的例子。

副业变现

第二个价值就是变现,AI写真目前在市面上需求还远远没有被满足,是一个很好的入场机会,现在这套技术几乎是市面上最具竞争力的,不仅可以做到质量很高,而且学习成本不高。

目前市面上那些要做得很好的,都要本身有比较强的PS技术来调整,这一项目做到了让用户不需要学习PS就能做出90分的效果。

为什么AI写真现在是一个很好的变现项目?

判断一个项目是否可行,一定是从需求开始分析

如果是一些大的项目,你需要自己去做MVP测试需求是否真实?

如果是比较小的项目,通常只需要去找到异常值就好了。

比如之前赛博机车的时候,别人一条内容的点赞只有1000,但评论却有2000多,同时评论区里的评论绝大多数都是这种有制作意愿的需求:

你再去想需求的群体是谁?是机车一族,他们本就是喜欢这些酷炫的东西,并愿意为之付费。

所以AI赛博机车图就正好符合这类人群需求,所以整个变现合理性一说出来,你能感觉到是通的。

那现在来看看AI写真项目:

你有一天刷小红书的时候,发现了下面的异常值:

一个480赞的内容,有157条评论,且更为重要的是,评论区都是需求,且都是已经明说要付费的需求。

这里的写真有女生自己想做的AI写真,也有宝妈想给宝宝做的AI写真,无一例外,女生、宝妈,都是非常有付费能力的群体,尤其是在小红书这样的平台上,更愿意为自己或者孩子付费。

同时写真这个产品的属性就意味着价格不会太低,外面自己去写真馆拍一套写真都要几百了,做一个AI写真,一张大几十也很合理。

希望你能通过这个项目真正赚到钱,无论是第一桶金也好,还是找到自己的副业方向都很值。

链接成长

首先自己的AI技术,SD也好,MJ也好,如果你之前一直没学会,你跟着教程和社群完整的操作实践下来,这块的技能就补上了。

同时你还会学会互联网项目的玩法,知道怎么做内容,怎么引流私域变现,积累这块的能力,以及你可以在群里和各路大神交流,互相学习、深度链接。

适合人群

①有执行力,愿意主动克服困难

②电脑设备有足够的配置支持,如果配置不够也愿意用云平台操作

③有准备好的小红书账号、抖音账号以及微信号,支持公域做内容

电脑配置

使用SD对电脑配置有一定的要求,为了后续大家能够更加顺利的使用SD,我们可以先检查一下自己的电脑配置。

首先,我们电脑分为Mac系统和Win系统,其中Win系统的显卡又分为N卡和A卡

这里我们Win系统的N卡,是最适合玩SD的,无论是最新的插件还是功能更新,N卡都是最快最适配的。

如果是Mac系统或者A卡的情况下,使用sd会比较容易出现报错,或者缺少某个功能,即便是Win系统的N卡,我们还要考虑电脑运行内存,和显卡内存的大小:

电脑运行内存推荐8GB以上

显卡的内存,也就是显存,需要在8GB以上

总结一下,就是Win系统N卡,运行内存8GB以上,显存8GB以上,可以在自己电脑下载软件。

Mac系统、A卡、以及电脑配置不太行的,就可以选择云平台,云电脑,相当于租用别人更高配置的电脑来使用SD

检查电脑配置操作流程

①首先鼠标右键点击桌面底部任务栏,打开任务管理器

②看到性能里面的内存,后面这个数字就是我们电脑的运行内存,也就是图片中划线的数字

这个内存如果显示的是8GB,那就说明你的电脑刚好达到使用SD的标准

③点击GPU,先看右上角的第一个单词

如果是“NVIDIA”就代表是N卡

如果是AMD就是A卡

接着看到下面专用GPU内存,后面的数字就是我们电脑的显存

显存需要在8GB以上,用SD出图才会比较顺畅

大家就按照自己电脑的实际情况,选择是在自己电脑本地下载软件,还是租用云平台。

AI写真项目拆解,手把手教学新手教程,ComfyUI版

Overseas 发表了文章 • 2024-03-22 10:23

一、分步制作

根据写真的SOP教程,蒙版变装的方法分为了四部分:

1、制作蒙版2、SD基础设置3、ControlNet设置4、修图

1、制作蒙版

根据教程中显示,制作蒙版是把脸部蒙版精准抠出,我们需要通过分割算法把脸部自动抠出,这里用到可以分割一切的seg(segment anything)

比葫芦画瓢,于是,小姐姐的脸完美扣出来了:

但在后期所有步骤连成后,发现遮罩边缘部分衔接不是太好,查了部分资料,发现是遮罩边缘太锋利导致,于是此处流程仍需要对蒙版边缘做羽化处理,核心节点就有,但试了一下,边缘依然比较清晰,发现核心节点feather mask是对整个图进行羽化,这不是我们想要的,我们只想对脸部进行羽化,这里用的是FeatheredMask节点。

通过FeatheredMask节点完美实现对边缘的羽化处理,如下图可以看到边缘明显不那么锐利:

到这里,第一步制作蒙版基本就达到我们想要的效果了。

2、SD基础设置

玩过ComfyUI的同学,相信这一步应该非常熟练的还原教程。

加载对应的大模型和lora,这里主要lora要和大模型相互匹配哦,通过lora模型的说明上可以看到使用什么大模型,如下图,冰雪奇缘这里用的麦橘V7:

这里属于基础部分,我就直接放流程图了,参数调节根据lora模型要求填写即可:

但是!这里依然有有一些细节需要注意,如果我们选择的适用于webui的提示词和参数配置的lora模型,我们需要用webui的提示词权重插值的方法,否则出的图和lora模型的表现有一定的差距。

啥意思呢,讲人话,就是目前大部分lora模型给出的效果图以及提示词都是从webui上得出得结论,但并不一定适用于comfyui,两种方式对提示词编码时的权重插值是有差异的,这也是经常有小伙伴通过ComfyUI还原WebUI时经常发现不能完美还原的一个非常非常重要的原因。

因此为了保证完美还原,这里又引入了一个节点,这个节点允许我们把权重插值方法改为A1111,也就是WebUI的提词权重插值方式,如下图:

根据上面接上,我们把之前的流程再重新修改,于是如下图:

可以看出两张图是有明显差别的,第一次的图明显锐化比较严重,第二次就好很多了。

到这里,SD基础设置中的前半部分就ok了,后边就是对蒙版内容和现在的采样器进行结合,教程中是重绘非蒙版内容,并且对蒙版区域采用潜空间噪声设置,因此这里需要在潜空间添加噪声以达到比较好的效果,对应ComfyUI可以用设置Latent噪波遮罩,并把图像编码传给采样器一同处理,这里就可以把空latent删除掉啦:

如上图,我们生成测试一下,发现遮罩部分完美把脸部迁移了,背景也重绘了,目前达到我们的效果。

剩下的就交给ControlNet来处理吧。

3、ControlNet设置

在ControlNet设置的教程里,主要用了openpose和lineart来控制人物的姿态和脸型,且用lineart控制脸部结构时需要手动把多余部分擦出掉。

这部分我想了好久,发现目前没有好的方式实现,但深入思考后,能够发现擦这部分的作用其实是防止衣服和背景的多余线条影响重绘得内容,那我用稍微欠一点的预处理器是不是能行呢,最终用HED模糊线预处理器感觉还凑活,生成的图像并没有太多线条,应该可以用:

然后加上openpose试一下:

把两个ControlNet串联后接入到采样器就可以啦,先看下生成效果:

看效果感觉用HED还凑活,那就继续。

4、修图

修图主要是对脸部边缘部分进行修复,使其融合的更自然。

教程里用的图生图的局部重绘,这里我们不想用手动去涂抹,ControlNet中有个inpaint预处理器啊,这个玩意也是干这个事得,而且比局部重绘的融合度会稍好一些,我们只需要让其对蒙版和原图的衔接部位进行重绘即可,控制好幅度应该可行。

于是,ControlNet中仍然需要再串联一层inpaint:

如上图,把inpaint串联上去,我们再看下效果吧:

看起来比之前效果确实要好不少。

到这里,整个还原就结束了,为了更清晰的划分不同模块,并做下后期放大,后面篇幅增加了放大功能。

二、后期优化

原图质量越好,生成的图也会越好,但大部分可能原图像素比较低,这里可以通过工作流直接组合放大功能。

这里我只用了SD放大,大家可以参考上面的文章,把图像放大到合适的大小哦。

可以看到图像被放大后还是很清晰的,并且经过重采样后,融合度可以说是完美。

但经过重采样的放大的图像会和原图略有区别,就和美颜后一样,这个可以通过调节降噪幅度自行调节到自己想要的程度。(ps: 效果是不是类似于插件instantid换脸法呢,嘿嘿!当然通过instantid换脸通过comfyui是比较容易做到的,属于比较基础的部分啦,小伙伴感兴趣的可以自己去实验吧)

为了方便查看,我对节点做了少许整理,并对刚才的分布制作单独分组,方便大家分块学习。

下面的两个图片和一个Json文件选取一个导入comfyui中即可展示全部流程了。

AI写真变现项目,新书小白也能轻松上手的保姆级教程(建议收藏)

newsman 发表了文章 • 2024-03-22 09:19

在介绍这个项目之前要先让你看看AI写真项目的作品成品,觉得不错有市场,有人愿意买单,你再继续往下看,否则划走就行。

案例效果展示

不止是小孩,成年女生的也可以,以往如果要拍出一套写真,要布景,妆造,拍摄,修图等等一套流程,而现在用AI,只需要2分钟就可以出来:

白衣天使和黑暗女王,海皇都可以,可以说只有你想不到的,没有她做不到:

除了女生之外,针对宝妈的小孩AI写真也是重中之重:

这个是小孩的原图,然后我们可以做成龙年写真,或者这样很帅的机甲风,小小魔法师等

变现机会分析

生活赋能

说实话,学会这项技能自己用或者在朋友圈炫一下已经很值了。

如果你是学生,帮自己、或者同学、女朋友、家人做一组这样的AI写真,无论是生日礼物,还是拿来泡妞搏女神一笑,还是就做完发朋友圈装逼,都会获得很高的点赞量。

如果你是女孩子或者宝妈,帮自己和自己的孩子,或者好闺蜜,朋友,同事做一套AI写真,这是多好的一件事情。

熟悉我的朋友都知道,通常来说我只会推荐我认为真正有价值的项目,AI写真就是一个除了变现以外还非常有价值的项目,再怎么样学会了这样一项技能后,都能帮自己在日常生活中用起来,这个就是我们普通人通过运用AI帮助自己的生活变得更好的例子。

副业变现

第二个价值就是变现,AI写真目前在市面上需求还远远没有被满足,是一个很好的入场机会,现在这套技术几乎是市面上最具竞争力的,不仅可以做到质量很高,而且学习成本不高。

目前市面上那些要做得很好的,都要本身有比较强的PS技术来调整,这一项目做到了让用户不需要学习PS就能做出90分的效果。

为什么AI写真现在是一个很好的变现项目?

判断一个项目是否可行,一定是从需求开始分析

如果是一些大的项目,你需要自己去做MVP测试需求是否真实?

如果是比较小的项目,通常只需要去找到异常值就好了。

比如之前赛博机车的时候,别人一条内容的点赞只有1000,但评论却有2000多,同时评论区里的评论绝大多数都是这种有制作意愿的需求:

你再去想需求的群体是谁?是机车一族,他们本就是喜欢这些酷炫的东西,并愿意为之付费。

所以AI赛博机车图就正好符合这类人群需求,所以整个变现合理性一说出来,你能感觉到是通的。

那现在来看看AI写真项目:

你有一天刷小红书的时候,发现了下面的异常值:

一个480赞的内容,有157条评论,且更为重要的是,评论区都是需求,且都是已经明说要付费的需求。

这里的写真有女生自己想做的AI写真,也有宝妈想给宝宝做的AI写真,无一例外,女生、宝妈,都是非常有付费能力的群体,尤其是在小红书这样的平台上,更愿意为自己或者孩子付费。

同时写真这个产品的属性就意味着价格不会太低,外面自己去写真馆拍一套写真都要几百了,做一个AI写真,一张大几十也很合理。

希望你能通过这个项目真正赚到钱,无论是第一桶金也好,还是找到自己的副业方向都很值。

链接成长

首先自己的AI技术,SD也好,MJ也好,如果你之前一直没学会,你跟着教程和社群完整的操作实践下来,这块的技能就补上了。

同时你还会学会互联网项目的玩法,知道怎么做内容,怎么引流私域变现,积累这块的能力,以及你可以在群里和各路大神交流,互相学习、深度链接。

适合人群

①有执行力,愿意主动克服困难

②电脑设备有足够的配置支持,如果配置不够也愿意用云平台操作

③有准备好的小红书账号、抖音账号以及微信号,支持公域做内容

电脑配置

使用SD对电脑配置有一定的要求,为了后续大家能够更加顺利的使用SD,我们可以先检查一下自己的电脑配置。

首先,我们电脑分为Mac系统和Win系统,其中Win系统的显卡又分为N卡和A卡

这里我们Win系统的N卡,是最适合玩SD的,无论是最新的插件还是功能更新,N卡都是最快最适配的。

如果是Mac系统或者A卡的情况下,使用sd会比较容易出现报错,或者缺少某个功能,即便是Win系统的N卡,我们还要考虑电脑运行内存,和显卡内存的大小:

电脑运行内存推荐8GB以上

显卡的内存,也就是显存,需要在8GB以上

总结一下,就是Win系统N卡,运行内存8GB以上,显存8GB以上,可以在自己电脑下载软件。

Mac系统、A卡、以及电脑配置不太行的,就可以选择云平台,云电脑,相当于租用别人更高配置的电脑来使用SD

检查电脑配置操作流程

①首先鼠标右键点击桌面底部任务栏,打开任务管理器

②看到性能里面的内存,后面这个数字就是我们电脑的运行内存,也就是图片中划线的数字

这个内存如果显示的是8GB,那就说明你的电脑刚好达到使用SD的标准

③点击GPU,先看右上角的第一个单词

如果是“NVIDIA”就代表是N卡

如果是AMD就是A卡

接着看到下面专用GPU内存,后面的数字就是我们电脑的显存

显存需要在8GB以上,用SD出图才会比较顺畅

大家就按照自己电脑的实际情况,选择是在自己电脑本地下载软件,还是租用云平台。